在基于神经网络的数字预失真(DPD)模型中,使用不同的激活函数对整个系统性能和能效有何影响?

像整流线性单元(ReLU)这类计算高效的激活函数能够降低能耗,因此更适合移动设备和物联网设备等资源受限的环境。相反,诸如 sigmoid 和 tanh 等更复杂的函数,尽管在某些场景下能带来更优的性能,但由于计算需求更高,可能会增加能耗。因此,在数字预失真(DPD)模型中选择激活函数时,需同时兼顾性能和能效,以根据目标应用优化系统。

为了解决下一代无线通信中功率放大器(PA)的信号失真和效率低下的难题,本文提出了一种AI驱动的数字预失真(DPD)框架。基于多项式的传统DPD方法存在计算复杂性问题,而且对非线性和记忆效应的适应能力有限。本文提出的系统利用了先进的神经网络架构动态优化预失真,在效率、适应性和实时校正等方面均优于传统方法。尽管存在模型可解释性和能耗等挑战,基于此框架打造的可扩展、高效率的解决方案依然代表了现代通信网络射频发射器设计的一项重大进步。

OpenAI于2022年11月推出的ChatGPT,是史上用户增长速度最快的软件产品之一,充分展现了人工智能(AI)的巨大潜力。机器学习(ML)是AI的一个分支,能够促进计算机执行决策和数据分析等任务,深刻改变了各行各业。在通信领域,数字预失真(DPD)技术在AI和ML的推动下不断发展,这项技术对于减少信号失真和提升功率放大器(PA)的效率至关重要。传统DPD模型难以处理5G等现代通信系统中存在的非线性特性和记忆效应。这些传统模型假定PA的行为是静态且无记忆的,因此仅通过多项式来描述输入输出之间的瞬时关系。然而,AI和ML擅长学习复杂模式,因此能够给出更精确的解决方案。本文提出了一种基于人工神经网络的DPD框架,利用PA数据来降低增益/相位误差、提升效率并改善频谱性能,其效果优于传统方法。

提升PA效率:数字预失真技术融合AI创新

数字预失真是一项关键技术,它使功率放大器能够在饱和区附近高效工作,同时不损害线性度。DPD通过扩展PA的线性工作范围,让射频(RF)设计人员能够充分利用非线性PA的效率优势,同时保持发射信号的线性度,满足正交频分复用(OFDM)等复杂调制方案的需求。

DPD的基本原理是预失真系数的引入。预失真系数是基于对PA的逆向幅度到幅度(AM-to-AM)和幅度到相位(AM-to-PM)的特性进行建模而得出的。在此过程中,精确的反失真被引入输入波形中,从而有效补偿PA的非线性。因此,DPD不仅能改善信号质量,而且让PA能够以峰值效率工作。关于DPD算法及ADI公司的 ADRV9040 RF 收发器如何为DPD的设计和实现提供精简硬件平台的详细内容,请参阅“简化5G基站发射器配置、设计和评估” 一文。图1展示了利用DPD使PA响应线性化的原理。

图1. 利用DPD使PA响应线性化的原理:(a)整体线性区域的典型AM到AM曲线(绿色);(b)DPD的基本概念以及它如何提升功率放大器的效率。

功率放大器在接近饱和时会表现出非线性,从而导致信号失真、频谱再生和效率降低,这在具有I/Q不平衡和记忆效应等缺陷的高带宽系统中尤其显著。AI和ML,尤其是神经网络(NN),能够对PA失真进行建模并动态优化预失真,从而带来颠覆性的改进。这种AI驱动的方法提升了系统的效率和适应性,优于传统方法,同时在性能和计算复杂性之间取得了平衡。

利用神经网络模型优化DPD引擎:一个颠覆性框架的提出

人工神经网络是人工智能的基石,尤其是在深度学习领域。神经网络的设计初衷是为了克服传统机器学习算法的局限性。受人类大脑处理信息能力的启发,神经网络擅长模式识别、学习和决策,因此非常适合解决复杂的非线性问题。例如,在5G LTE系统中,利用基于神经网络的DPD方法可以有效解决I/Q不平衡、相移、DC偏移、串扰和PA非线性等难题。

基于多项式的DPD方案依赖于对系统机制的深入理解,且难以扩展;相比之下,神经网络模型擅长以较少的约束条件处理复杂的非线性行为。本节文章提出一种NN DPD框架,以减轻非线性和发射器缺陷的影响。过程中涉及三个关键步骤:测试PA特性并收集大量数据、训练后失真神经网络模型、部署模型并进行性能监控和调整。此方法通过机器学习将大型数据集转化为可实践的操作,从而为应对现代通信挑战提供稳健、可扩展的解决方案。

第1步:收集PA特性数据

为了设计和实现用于优化无线功率放大器的AI/ML模型,收集全面、高质量的特性数据至关重要,这些数据应当准确反映PA在不同条件下的实际性能。图2显示了一种可用于PA特性数据收集的示例配置。

图2. 用于宽带PA特性分析的测量配置。

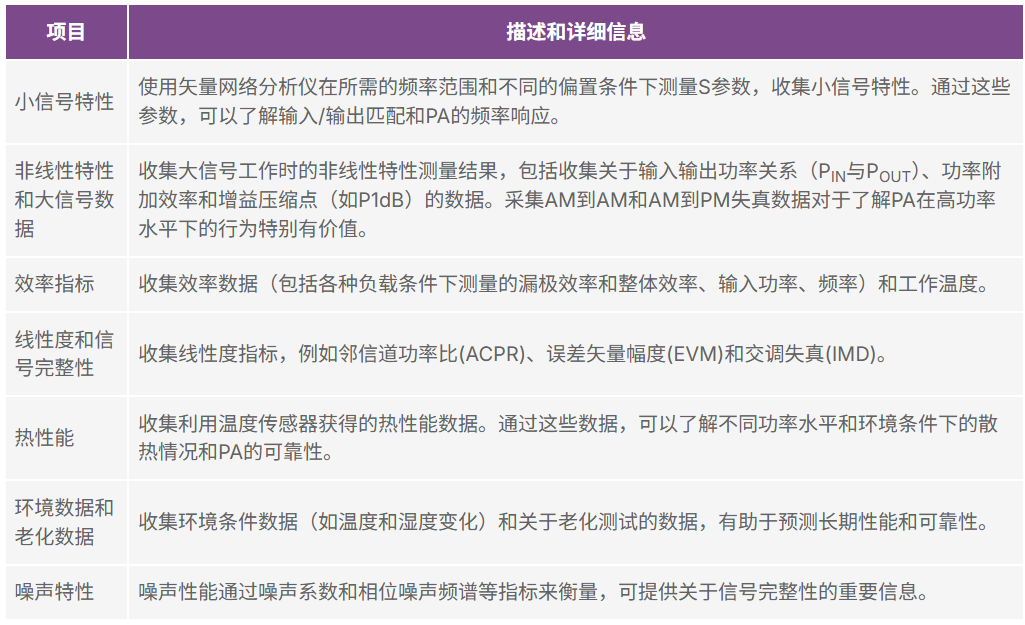

通过图2所示的测试平台可以全面分析器件特性,提取S参数、输出功率、功率附加效率(PAE)、输入阻抗、输入回波损耗、功率增益、AM到PM转换等其他参数。表1详细列出了模型所需的所有输入数据。但需要注意的是,模型的维数会影响其响应时间。此外,采集的数据必须先数字化,然后才能用于训练过程。

表1. 测量项目及其描述

这种严格而系统的数据收集方法为开发能够准确预测和优化PA性能的AI/ML模型奠定了基础。借助这种全面的数据集,设计人员可以实现可靠、高效的无线通信系统。

第2步:训练模型

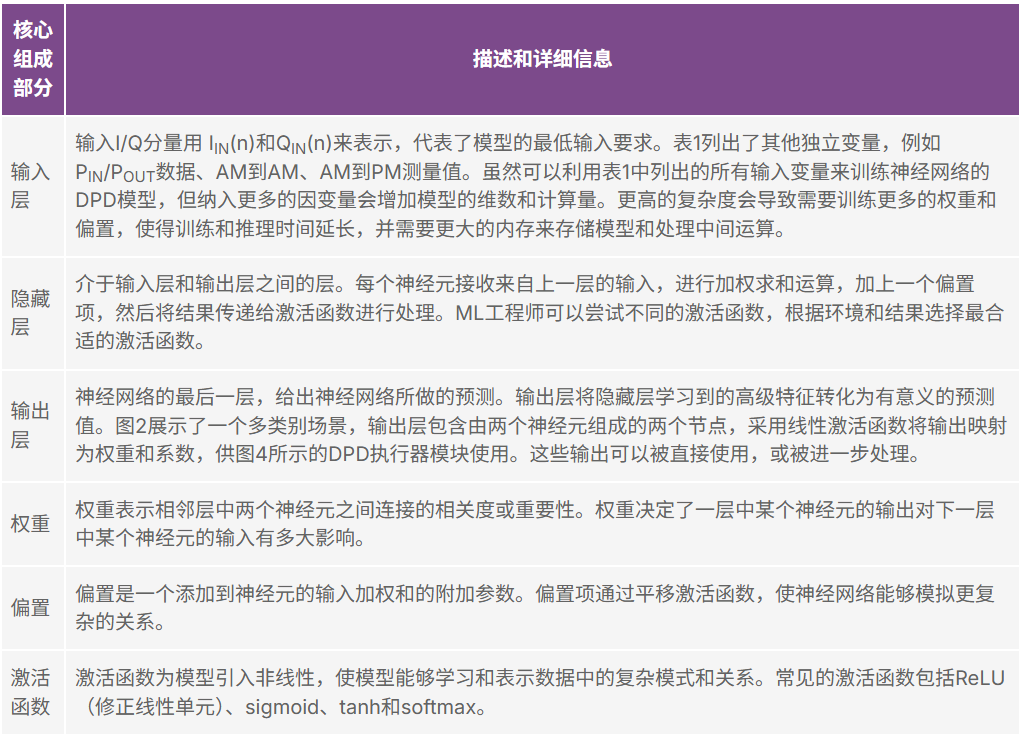

模型训练过程包括将表1中收集的(部分或全部)信号输入到系统中,并通过损失函数来优化DPD模型以使误差最小化。神经网络架构由相互连接的节点层(例如人工神经元)组成,即图3所示的组成部分。

图3. 深度学习中的多类别预测神经网络架构。

表2. 神经网络核心组成部分和描述

在训练期间,隐藏层使数据前向传播,而权重和偏置通过反向传播和梯度下降算法进行优化。神经网络结构可进行调整,以包含更多神经元(适用于高度非线性的分量)或更少神经元(适用于较平滑的元素)。

关于哪些AI硬件、软件和工具最适合用来创建高效、可扩展的AI模型训练环境,本文不作深入探讨,但我们建议AI工程师可以尝试一下KNIME,这是一个用于数据分析和机器学习的无代码平台。KNIME具有图形用户界面(GUI),用户只需拖放节点即可设计工作流程,无需掌握大量编程知识。所设计的工作流程非常直观且易于理解,因此适合广大用户使用。对于更倾向于使用Python进行开发的人来说,Keras与TensorFlow的结合能带来显著优势,将Keras的简单易用性与TensorFlow的稳健性和可扩展性相融合,是实验级或生产级深度学习应用等各类项目的理想选择。

PA特性分析工作涉及到百万级样本的收集,其中70%用于训练,30%用于测试和验证,以评估模型模拟PA行为的能力。模型性能通过准确率、精度、召回率、F1分数和ROC-AUC等指标来评估。

第3步:验证和部署神经网络模型

部署过程从模型的验证开始,以确保模型的稳健性和准确性。验证集用于监控训练质量并决定何时停止训练,测试集则用于独立评估模型的准确性和泛化能力。解决过拟合和欠拟合问题,对于确保模型在新数据集上的表现至关重要。为抑制过拟合、提升模型的泛化能力,可采用以下方法:精简模型架构,限制神经网络层数、隐藏神经元数量或参数规模;扩充训练数据集规模;或实施裁剪,例如剔除对模型性能影响微弱的冗余神经元。另一方面,为抑制欠拟合,可以增加隐藏神经元以提升模型的复杂性,或调整学习率、批量大小、正则化强度等超参数以改善性能。ML工程师必须平衡上述种种策略,并迭代评估DPD模型的性能,从而实现稳健且可泛化的模型,同时保证模型的执行速度。图4显示了神经网络DPD模型评估系统架构的总体框图。

图4. 神经网络DPD模型评估平台的框图。

在任何情况下,要确定隐藏神经元的最佳数量,必须依靠实证研究、反复试错或在训练过程中采用自适应方法。这些调整有助于确保神经网络在复杂性和性能之间取得适当平衡,从而实现高效且有效的模型部署。在部署模型的过程中,采用边缘AI嵌入式MCU,例如ADI公司的 MAX78000 卷积神经网络加速器芯片,可以简化模型的部署。

AI/ML与DPD系统集成:挑战与机遇

将人工智能和机器学习融入DPD系统,有望大幅提升系统性能,但也带来了一些现实挑战。DPD系统需要低延迟和高处理速度,而这对于计算密集型ML模型来说很难实现。此外,为了在温度波动、硬件老化等动态运行条件下保持最佳性能,必须采用实时学习或迁移学习等自适应技术。

功耗是另一个关键考量因素。AI/ML模型(尤其是深度学习架构)往往比传统DPD方法更耗电,因此不太适合对功耗敏感的环境。未来的实验应该采用轻量级神经网络,即标准神经网络的优化版本。轻量级神经网络在设计上减少了参数数量,降低了算力需求,并提高了内存利用效率,对于计算资源有限的应用特别有用,例如移动和物联网(IoT)设备或其他资源受限的系统。

许多ML模型(尤其是深度神经网络)缺乏可解释性,进一步加剧了它们与DPD系统集成的复杂性。神经网络模型将复杂的操作简化为权重、偏置和激活函数,工作过程并不透明,因此调试和优化是相当困难的。

结语

大规模MIMO等5G技术要求更低的功耗和更高的精度,DPD系统必须不断发展以应对新的复杂性。通过自适应学习和混合建模等创新,AI/ML将为实现可扩展、高效节能的解决方案提供关键支持。神经网络能够模拟复杂的非线性关系和记忆效应,无需明确的数学公式就能近似处理非线性函数,让DPD系统设计得以简化。

集成AI/ML有助于提升能效比,使PA能够在更接近饱和的状态下工作,同时利用非线性PA降低成本。虽然存在挑战,但AI/ML驱动的系统在增强DPD系统的精度、适应性和可扩展性方面潜力巨大。传统多项式与AI/ML技术相结合的混合方法能够提供一种均衡的解决方案,既保留了经典模型的可解释性,又融合了AI/ML的先进能力。在AI/ML的助力下,通过创新策略应对种种挑战,可以推动DPD系统取得突破性进展,进而支持现代通信技术的持续进步。

-

神经网络

+关注

关注

42文章

4816浏览量

104704 -

AI

+关注

关注

88文章

36064浏览量

283599 -

模型

+关注

关注

1文章

3567浏览量

50840 -

数字预失真

+关注

关注

3文章

25浏览量

13760

原文标题:模拟对话丨实现更智能的数字预失真引擎:一种基于神经网络的方法

文章出处:【微信号:analog_devices,微信公众号:analog_devices】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

基于神经网络的数字预失真模型解决方案

基于神经网络的数字预失真模型解决方案

评论