1. OpenAI终于Open一回:DALL-E 3论文公布、上线ChatGPT,作者一半是华人

原文:https://mp.weixin.qq.com/s/xLvJXe2FDL8YdByZLHjGMQ

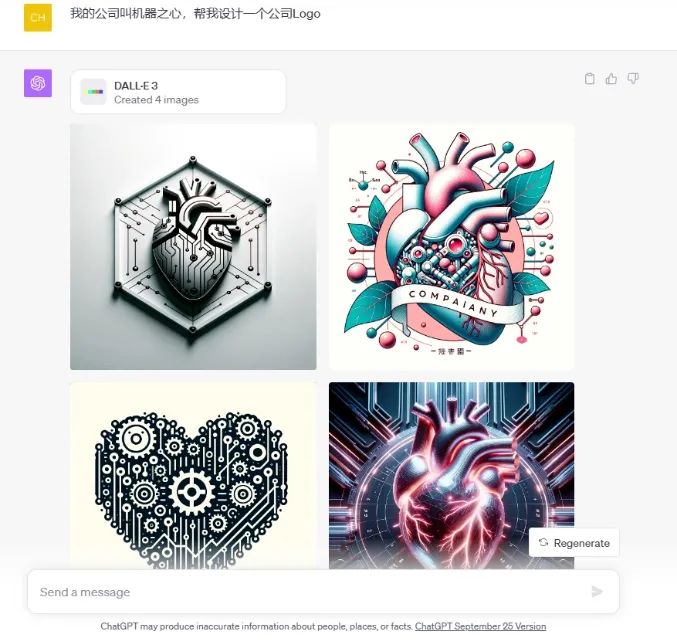

打开 ChatGPT 就能用 DALL?E 3 生成图片了,OpenAI 还罕见地发布了一些技术细节。

终于,「OpenAI 又 Open 了」。在看到 OpenAI 刚刚发布的 DALL?E 3 相关论文后,一位网友感叹说。DALL?E 3 是 OpenAI 在 2023 年 9 月份发布的一个文生图模型。与上一代模型 DALL?E 2 最大的区别在于,它可以利用 ChatGPT 生成提示(prompt),然后让模型根据该提示生成图像。对于不擅长编写提示的普通人来说,这一改进大大提高了 DALL?E 3 的使用效率。此外,与 DALL?E 2 相比,DALL?E 3 生成的图质量也更高。

即使与当前最流行的文生图应用 Midjourney 相比,DALL?E 3 也能打个平手甚至超越 Midjourney。而且与 Midjourney 相比,DALL?E 3 不需要用户自己掌握复杂的 Prompt 编写知识,使用起来门槛更低。

即使与当前最流行的文生图应用 Midjourney 相比,DALL?E 3 也能打个平手甚至超越 Midjourney。而且与 Midjourney 相比,DALL?E 3 不需要用户自己掌握复杂的 Prompt 编写知识,使用起来门槛更低。 这一模型的发布引发了不小的轰动,也再次巩固了 OpenAI 技术领头羊的形象。一时间,所有人都很好奇,这么炸裂的效果是怎么做到的?不过,令人失望的是,当时 OpenAI 并没有透露技术细节,就像之前发布 GPT-4 时一样。不过,一个月后,OpenAI 还是给了大家一些惊喜。在一份篇幅达 22 页的论文中,他们阐述了针对 DALL?E 3 所做的改进。论文要点包括:

这一模型的发布引发了不小的轰动,也再次巩固了 OpenAI 技术领头羊的形象。一时间,所有人都很好奇,这么炸裂的效果是怎么做到的?不过,令人失望的是,当时 OpenAI 并没有透露技术细节,就像之前发布 GPT-4 时一样。不过,一个月后,OpenAI 还是给了大家一些惊喜。在一份篇幅达 22 页的论文中,他们阐述了针对 DALL?E 3 所做的改进。论文要点包括:- 模型能力的提升主要来自于详尽的图像文本描述(image captioning);

- 他们训练了一个图像文本描述模型来生成简短而详尽的文本;

- 他们使用了 T5 文本编码器;

- 他们使用了 GPT-4 来完善用户写出的简短提示;

- 他们训练了一个 U-net 解码器,并将其蒸馏成 2 个去噪步骤;

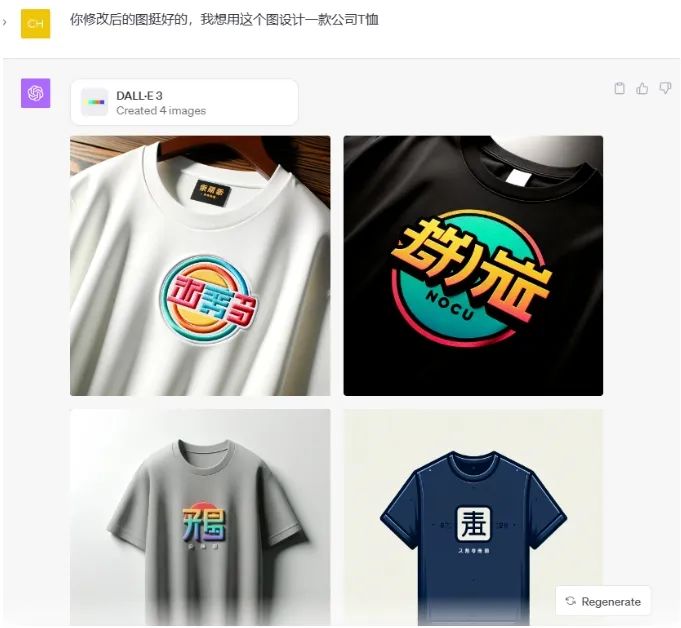

- 文本渲染仍然不可靠,他们认为该模型很难将单词 token 映射为图像中的字母

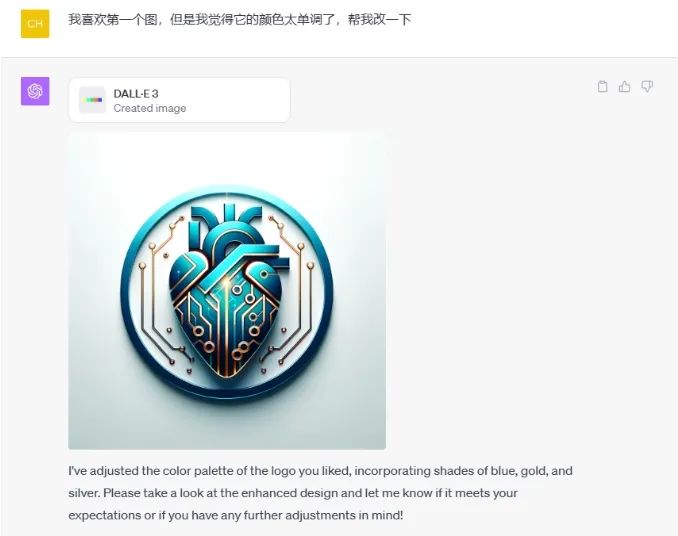

如果对结果不满意,你还可以直接让它在原图的基础上修改:

如果对结果不满意,你还可以直接让它在原图的基础上修改: 不过,随着对话长度的增加,生成结果变得有些不稳定:

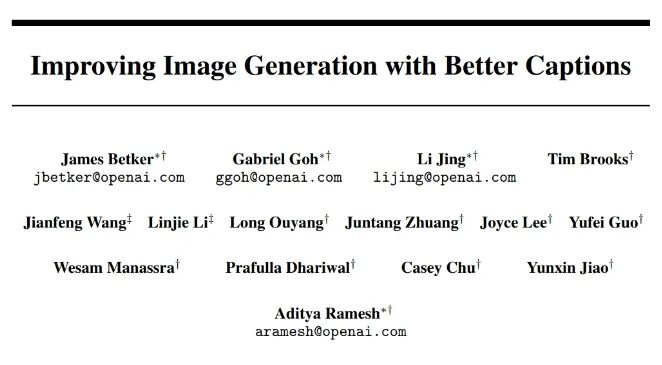

不过,随着对话长度的增加,生成结果变得有些不稳定: 为了保证 DALL?E 3 输出内容的安全性和合规性,OpenAI 也做了一些努力,确保模型输出的内容是被检查过的,而且不侵犯在世艺术家的版权。当然,要了解 DALL?E 3 背后的技术,还是要详细阅读论文。以下是论文介绍:论文概览OpenAI 发布的 DALL?E 3 相关论文总共有 19 页,作者共有 15 位,半数为华人,分别来自 OpenAI 和微软。

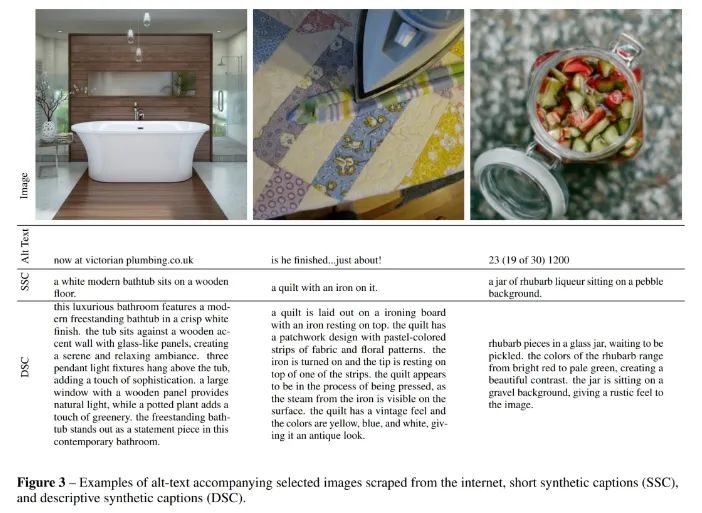

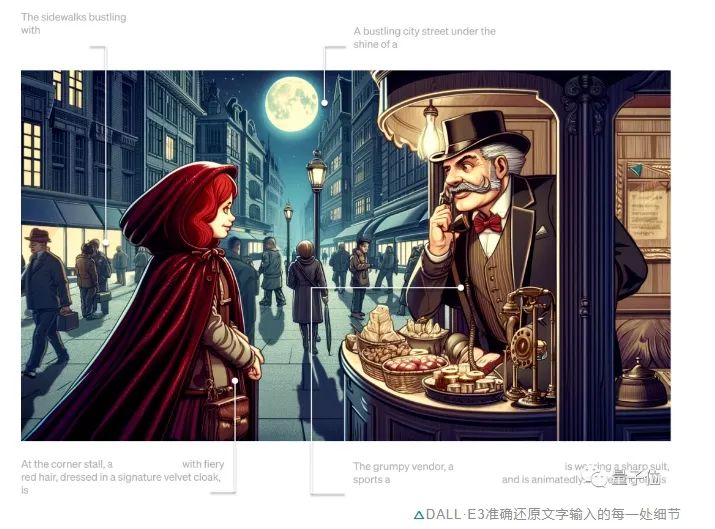

为了保证 DALL?E 3 输出内容的安全性和合规性,OpenAI 也做了一些努力,确保模型输出的内容是被检查过的,而且不侵犯在世艺术家的版权。当然,要了解 DALL?E 3 背后的技术,还是要详细阅读论文。以下是论文介绍:论文概览OpenAI 发布的 DALL?E 3 相关论文总共有 19 页,作者共有 15 位,半数为华人,分别来自 OpenAI 和微软。 论文地址:https://cdn.openai.com/papers/dall-e-3.pdf论文提出了一种解决提示跟随(prompt following)问题的新方法:文本描述改进(caption improvement)。本文假设现有的文本 - 图像模型面临的一个基本问题是:训练数据集中的文本 - 图像对的质量较差,这一问题在其他研究中也已经被指出。本文建议通过为数据集中的图像生成改进的文本描述来解决这个问题。为了达到这一目标,该研究首先学习了一个具有稳健性的图像文本生成器,它可以生成详细、准确的图像描述。然后,将此文本生成器应用到数据集以生成更详细的文本。最终在改进的数据集上训练文本 - 图像模型。其实,用合成数据进行训练并不是一个全新的概念。本文的贡献主要在于研究者构建了一个新颖的具有描述性的图像文本系统,并对用合成文本训练生成的模型进行了评估。该研究还为一系列评估建立了一个可重复的基准性能概要文件,这些评估用于测量提示执行的情况。在接下来的章节中,第 2 节对训练图像文本生成器的策略进行了全面概述,第 3 节对在原始文本和生成文本上训练的文本到图像模型进行了评估,第 4 节对 DALL-E 3 进行了评估,第 5 节讨论了限制和风险。下面我们看看每个章节的具体内容。数据集重描述(Recaptioning)OpenAI 的文本到图像模型是在大量 (t, i) 对组成的数据集上进行训练的,其中 i 是图像,t 是描述图像的文本。在大规模数据集中,t 通常源于人类作者,他们主要对图像中的对象进行简单描述,而忽略图像中的背景细节或常识关系。更糟糕的是,在互联网上找到的描述往往根本不正确或者描述与图像不怎么相关的细节。OpenAI 认为所有的缺陷都可以使用合成描述来解决。为了改进在图像生成数据集上的描述效果,OpenAI 希望使用描述生成器来生成图像描述,这有助于学习文本到图像模型。在首次尝试中,他们构建了一个仅能描述图像主对象的小规模描述数据集,然后继续在这个数据集上训练自己的描述生成器。该过程诱导的更新到 θ 使得模型偏向于描述图像的主对象。OpenAI 将这种微调生成的描述称为「短合成描述」。OpenAI 做了第二次尝试,创建了一个更长的、描述更丰富的文本数据集,来描述微调数据集中每个图像的内容。這些描述包括图像的主对象,以及周围对象、背景、图像中的文本、风格、颜色。他们在该数据集上对基础文本生成器进行进一步微调,并将该文本生成器生成的文本称为「描述性合成描述」。下图 3 展示了真值、短合成和描述性合成描述的示例

论文地址:https://cdn.openai.com/papers/dall-e-3.pdf论文提出了一种解决提示跟随(prompt following)问题的新方法:文本描述改进(caption improvement)。本文假设现有的文本 - 图像模型面临的一个基本问题是:训练数据集中的文本 - 图像对的质量较差,这一问题在其他研究中也已经被指出。本文建议通过为数据集中的图像生成改进的文本描述来解决这个问题。为了达到这一目标,该研究首先学习了一个具有稳健性的图像文本生成器,它可以生成详细、准确的图像描述。然后,将此文本生成器应用到数据集以生成更详细的文本。最终在改进的数据集上训练文本 - 图像模型。其实,用合成数据进行训练并不是一个全新的概念。本文的贡献主要在于研究者构建了一个新颖的具有描述性的图像文本系统,并对用合成文本训练生成的模型进行了评估。该研究还为一系列评估建立了一个可重复的基准性能概要文件,这些评估用于测量提示执行的情况。在接下来的章节中,第 2 节对训练图像文本生成器的策略进行了全面概述,第 3 节对在原始文本和生成文本上训练的文本到图像模型进行了评估,第 4 节对 DALL-E 3 进行了评估,第 5 节讨论了限制和风险。下面我们看看每个章节的具体内容。数据集重描述(Recaptioning)OpenAI 的文本到图像模型是在大量 (t, i) 对组成的数据集上进行训练的,其中 i 是图像,t 是描述图像的文本。在大规模数据集中,t 通常源于人类作者,他们主要对图像中的对象进行简单描述,而忽略图像中的背景细节或常识关系。更糟糕的是,在互联网上找到的描述往往根本不正确或者描述与图像不怎么相关的细节。OpenAI 认为所有的缺陷都可以使用合成描述来解决。为了改进在图像生成数据集上的描述效果,OpenAI 希望使用描述生成器来生成图像描述,这有助于学习文本到图像模型。在首次尝试中,他们构建了一个仅能描述图像主对象的小规模描述数据集,然后继续在这个数据集上训练自己的描述生成器。该过程诱导的更新到 θ 使得模型偏向于描述图像的主对象。OpenAI 将这种微调生成的描述称为「短合成描述」。OpenAI 做了第二次尝试,创建了一个更长的、描述更丰富的文本数据集,来描述微调数据集中每个图像的内容。這些描述包括图像的主对象,以及周围对象、背景、图像中的文本、风格、颜色。他们在该数据集上对基础文本生成器进行进一步微调,并将该文本生成器生成的文本称为「描述性合成描述」。下图 3 展示了真值、短合成和描述性合成描述的示例 评估重描述(re-captioned)数据集OpenAI 利用重描述数据集,开始评估训练模型对合成文本的影响。他们尤其试图回答以下两个问题:

评估重描述(re-captioned)数据集OpenAI 利用重描述数据集,开始评估训练模型对合成文本的影响。他们尤其试图回答以下两个问题:- 使用每种类型的合成描述对性能有什么影响

- 合成描述与真值描述的最佳混合比例是多少?

- 合成与真值描述混合

- 评估方法

接下来针对为所有 50000 个文本 / 图像对计算的余弦距离,OpenAI 执行了平均操作,并做了 100 倍重缩放(rescale)。在计算 CLIP 分数,选择使用哪个描述非常重要。对于 OpenAI 的测试,他们要么使用真值描述,要么使用描述性合成描述。同时,每次评估时都注明使用了哪个描述。限制与风险本文的最后一章是大家比较关心的关于限制与风险的问题。虽然 DALL-E 3 在 prompt 跟随方面表现出色,但它仍然在空间感知等方面表现不佳。例如,DALL-E 3 不能很好的理解左边、下面、后面等表示方位的词语。此外,在构建文本描述生成器时,本文着重考虑了一些突出的引导词(prominent words),这些引导词存在于原本图像以及生成的描述中。因此,DALL-E 3 可以在出现 prompt 时生成文本。在测试过程中,本文注意到此功能并不可靠。本文怀疑这可能与使用 T5 文本编码器有关:当模型遇到 prompt 中的文本时,它实际上会看到代表整个单词的 token,并且将它们映射到图像中出现的文本。在未来的工作中,本文希望进一步探索字符级语言模型,以帮助改善 DALL-E 3 面临的这种限制。最后,本文还观察到,合成的文本还会让生成的图片在重要细节上产生幻觉。这对下游任务产生了一定的影响,本文也表示,DALL-E 3 在为特定术语生成图像方面并不可靠。不过,该研究相信,对图像文本描述的完善能进一步改进 DALL-E 3 的生成结果。

接下来针对为所有 50000 个文本 / 图像对计算的余弦距离,OpenAI 执行了平均操作,并做了 100 倍重缩放(rescale)。在计算 CLIP 分数,选择使用哪个描述非常重要。对于 OpenAI 的测试,他们要么使用真值描述,要么使用描述性合成描述。同时,每次评估时都注明使用了哪个描述。限制与风险本文的最后一章是大家比较关心的关于限制与风险的问题。虽然 DALL-E 3 在 prompt 跟随方面表现出色,但它仍然在空间感知等方面表现不佳。例如,DALL-E 3 不能很好的理解左边、下面、后面等表示方位的词语。此外,在构建文本描述生成器时,本文着重考虑了一些突出的引导词(prominent words),这些引导词存在于原本图像以及生成的描述中。因此,DALL-E 3 可以在出现 prompt 时生成文本。在测试过程中,本文注意到此功能并不可靠。本文怀疑这可能与使用 T5 文本编码器有关:当模型遇到 prompt 中的文本时,它实际上会看到代表整个单词的 token,并且将它们映射到图像中出现的文本。在未来的工作中,本文希望进一步探索字符级语言模型,以帮助改善 DALL-E 3 面临的这种限制。最后,本文还观察到,合成的文本还会让生成的图片在重要细节上产生幻觉。这对下游任务产生了一定的影响,本文也表示,DALL-E 3 在为特定术语生成图像方面并不可靠。不过,该研究相信,对图像文本描述的完善能进一步改进 DALL-E 3 的生成结果。2. 在RTX 4090被限制的时代下,让大模型使用RLHF更高效的方法来了

原文:https://mp.weixin.qq.com/s/3I0kOE1FprOeXSEERVVBIQ

该论文介绍了一种名为 ReMax 的新算法,专为基于人类反馈的强化学习(RLHF)而设计。ReMax 在计算效率(约减少 50% 的 GPU 内存和 2 倍的训练速度提升)和实现简易性(6 行代码)上超越了最常用的算法 PPO,且性能没有损失。

- 论文链接:https://arxiv.org/abs/2310.10505

- 作者:李子牛,许天,张雨舜,俞扬,孙若愚,罗智泉

- 机构:香港中文大学(深圳),深圳市大数据研究院,南京大学,南栖仙策

- 开源代码:https://github.com/liziniu/ReMax

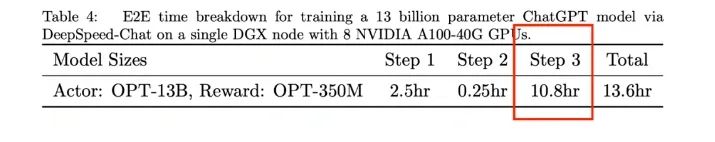

我们发现 RLHF 的主要计算开销来源于第三阶段(奖励最大化)。这一点可以从 DeepSpeed-Chat 的报告里看到,第三阶段的训练时间是前两个阶段时间总和的 4 倍以上。而且,根据我们的经验,第三阶段的 GPU 消耗是前两阶段的 2 倍以上。

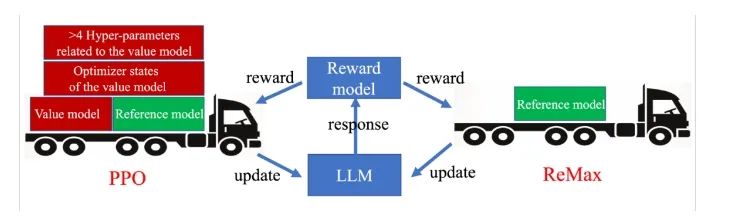

我们发现 RLHF 的主要计算开销来源于第三阶段(奖励最大化)。这一点可以从 DeepSpeed-Chat 的报告里看到,第三阶段的训练时间是前两个阶段时间总和的 4 倍以上。而且,根据我们的经验,第三阶段的 GPU 消耗是前两阶段的 2 倍以上。 目前 RLHF 第 3 阶段的主要计算瓶颈是什么?我们发现该阶段的计算瓶颈主要来源用来目前使用的 RL 算法:PPO 算法。PPO 算法是用来解决普适 RL 问题的最流行的算法之一,有非常多成功的案例。我们在这里省略 PPO 的技术细节,着重介绍 PPO 的一个关键组件:价值模型 (The value model)。价值模型是一个需要被训练的神经网络,能够有效地估计给定策略的预期长期回报。尽管价值模型为 PPO 带来了良好的性能,但它在 RLHF 任务中也引入了沉重的计算开销。例如,为了更好地与人类偏好对齐,PPO 中的价值模型通常与 LLM 大小相似,这使存储需求翻了一番。此外,价值模型的训练需要存储其梯度、激活和优化器状态,这进一步增加了近 4 倍的 GPU 存储需求。总结来说,PPO 和它的价值模型(以及其训练相关部分)已成为 RLHF 奖励最大化阶段的主要计算障碍。

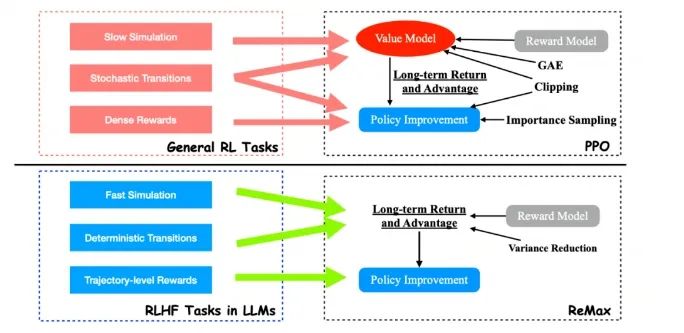

目前 RLHF 第 3 阶段的主要计算瓶颈是什么?我们发现该阶段的计算瓶颈主要来源用来目前使用的 RL 算法:PPO 算法。PPO 算法是用来解决普适 RL 问题的最流行的算法之一,有非常多成功的案例。我们在这里省略 PPO 的技术细节,着重介绍 PPO 的一个关键组件:价值模型 (The value model)。价值模型是一个需要被训练的神经网络,能够有效地估计给定策略的预期长期回报。尽管价值模型为 PPO 带来了良好的性能,但它在 RLHF 任务中也引入了沉重的计算开销。例如,为了更好地与人类偏好对齐,PPO 中的价值模型通常与 LLM 大小相似,这使存储需求翻了一番。此外,价值模型的训练需要存储其梯度、激活和优化器状态,这进一步增加了近 4 倍的 GPU 存储需求。总结来说,PPO 和它的价值模型(以及其训练相关部分)已成为 RLHF 奖励最大化阶段的主要计算障碍。 思路是否有可能找到比 PPO 更适配 RLHF 的算法?我们得出的答案是肯定的。这是因为 PPO 和价值模型是为通用 RL 问题设计的,而不是针对像 RLHF 这样的特定问题(RLHF 只是 RL 问题中的一个子类)。有趣的是,我们发现 RLHF 具有三个在 PPO 中未使用的重要结构:1. 快速模拟(fast simulation):轨迹(即 LLM 中的整个响应)可以在很短的时间内迅速执行(小于 1s),几乎没有时间开销。2. 确定性转移(deterministic transitions):上下文确定性依赖于过去的标记和当前生成的标记。3. 轨迹级奖励(trajectory-level rewards):奖励模型只在响应完成时提供一个奖赏值。通过这三个观察,我们不难发现 value model 在 RLHF 的问题中是 “冗余” 的。这是因为 value model 设计的初衷是为了随机环境下的样本效率和慢仿真环境的计算效率。然而这在 RLHF 中是不需要的。

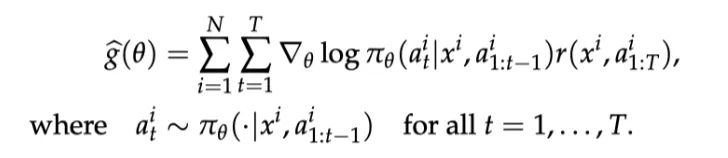

思路是否有可能找到比 PPO 更适配 RLHF 的算法?我们得出的答案是肯定的。这是因为 PPO 和价值模型是为通用 RL 问题设计的,而不是针对像 RLHF 这样的特定问题(RLHF 只是 RL 问题中的一个子类)。有趣的是,我们发现 RLHF 具有三个在 PPO 中未使用的重要结构:1. 快速模拟(fast simulation):轨迹(即 LLM 中的整个响应)可以在很短的时间内迅速执行(小于 1s),几乎没有时间开销。2. 确定性转移(deterministic transitions):上下文确定性依赖于过去的标记和当前生成的标记。3. 轨迹级奖励(trajectory-level rewards):奖励模型只在响应完成时提供一个奖赏值。通过这三个观察,我们不难发现 value model 在 RLHF 的问题中是 “冗余” 的。这是因为 value model 设计的初衷是为了随机环境下的样本效率和慢仿真环境的计算效率。然而这在 RLHF 中是不需要的。 方法ReMaxReMax 算法基于一个古老的策略梯度算法 REINFORCE,REINFORCE 使用的策略梯度估计器如下图所示:

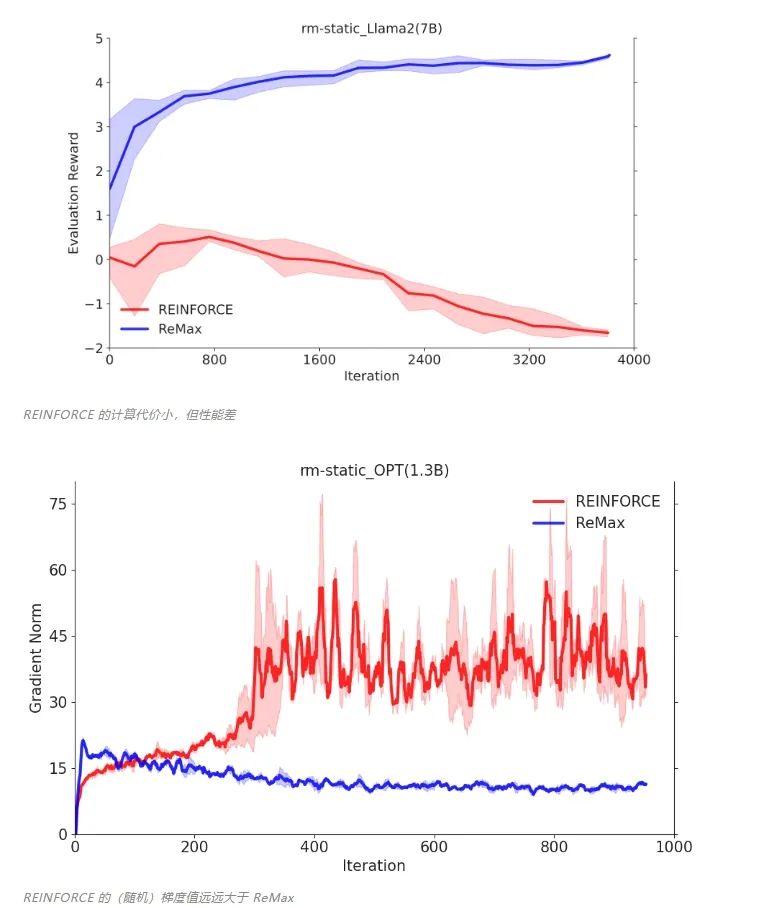

方法ReMaxReMax 算法基于一个古老的策略梯度算法 REINFORCE,REINFORCE 使用的策略梯度估计器如下图所示: REINFORCE可以在计算层面利用好RLHF任务的三个性质,因为REINFORCE直接利用一个响应的奖励来进行优化,不需要像一般的RL算法一样需要知道中间步骤的奖励和值函数。然而,由于策略的随机性, REINFORCE梯度估计器存在高方差问题(在Richard Sutton的RL书里有指出),这一问题会影响模型训练的有效性,因此REINFORCE在RLHF任务中的效果较差,见下面两张图片。

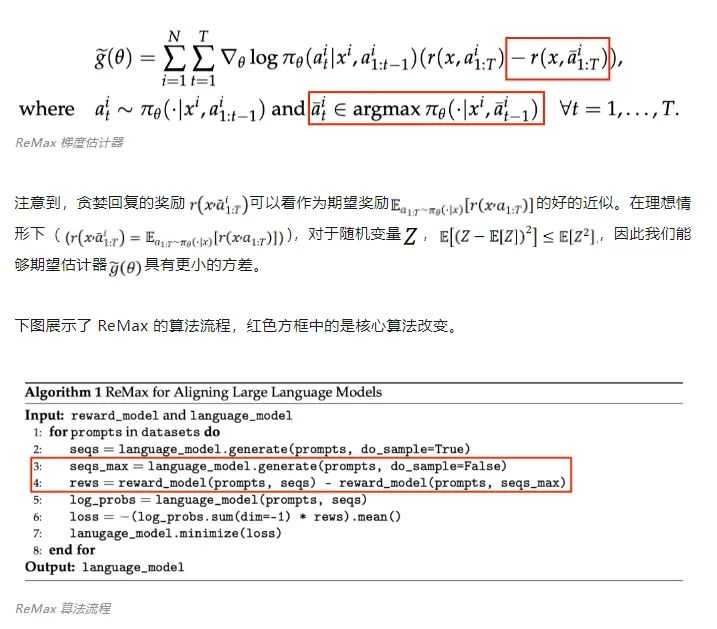

REINFORCE可以在计算层面利用好RLHF任务的三个性质,因为REINFORCE直接利用一个响应的奖励来进行优化,不需要像一般的RL算法一样需要知道中间步骤的奖励和值函数。然而,由于策略的随机性, REINFORCE梯度估计器存在高方差问题(在Richard Sutton的RL书里有指出),这一问题会影响模型训练的有效性,因此REINFORCE在RLHF任务中的效果较差,见下面两张图片。 为解决这一问题,ReMax 使用贪婪生成的回答(greedy response)的奖励作为基准值(baseline value)来构建梯度估计器,具体公式如下:

为解决这一问题,ReMax 使用贪婪生成的回答(greedy response)的奖励作为基准值(baseline value)来构建梯度估计器,具体公式如下: 理论保证 我们证明了 ReMax 使用的梯度估计器仍然是真实策略梯度的一个无偏估计器。详细理论介绍见论文。算法优点

理论保证 我们证明了 ReMax 使用的梯度估计器仍然是真实策略梯度的一个无偏估计器。详细理论介绍见论文。算法优点- ReMax 的核心部分可以用 6 行代码来实现。相比之下,PPO 要额外引入重要性采样(importance sampling),广义优势估计(generalized advantage estimation,GAE),价值模型学习等额外模块。

- ReMax 的超参数很少。相比之下,PPO 有额外的超参数,例如重要性采样剪切阈值(importance sampling clipping ratio)、GAE 系数、价值模型学习率,离策略训练轮次(off-policy training epoch)等,这些超参数都需要花大量时间去调优。

- ReMax 能理论上节省约 50% 内存。相比于 PPO,ReMax 成功移除了所有和价值模型相关的部件,大大减小了内存开销。通过计算,我们发现相比于 PPO,ReMax 能节省约 50% 内存。

- 更简单的实现:ReMax 的核心部分 6 行代码即可实现。这与 PPO 中的众多复杂的代码构建块形成鲜明对比。

- 更少的内存开销:由于移除了价值模型及其全部训练组件,相比 PPO,ReMax 节省了大约 50% 的 GPU 内存。

- 更少的超参数: ReMax 成功移除了所有和价值模型训练相关的超参数,其中包括:GAE 系数、价值模型学习率、重要性采样时期、小批量(mini-batch)大小。这些超参数往往对问题敏感且难以调整。我们相信 ReMax 对 RLHF 研究者更加友好。

- 更快的训练速度:在 GPT2(137M)的实验中,我们观察到 ReMax 在真实运行时间方面相比于 PPO 有 2.2 倍的加速。加速来自 ReMax 每次迭代中较少的计算开销。通过我们的计算,该加速优势在更大的模型上也能维持(假设在足够大的内存下 PPO 可以被成功部署)。

- 优异的性能:如前所示,ReMax在中等规模实验中与PPO实现了相当的性能,并且有时甚至超越它(可能是由于 ReMax 更容易找到合适的超参数)。我们推测这种良好的性能可以拓展到更大规模的模型中。

3. 10年市场规模1.3万亿美元,「模力时代」已来

原文:https://mp.weixin.qq.com/s/ps274X9uf_hTe0UopkGtsg大模型风暴刮了大半年,AIGC市场开始起了新的变化:酷炫的技术Demo,正在被完整的产品体验所取代。比如,OpenAI最新AI绘画模型DALL· E 3刚一登场,就跟ChatGPT强强联合,成为ChatGPT Plus里最令人期待的新生产力工具。

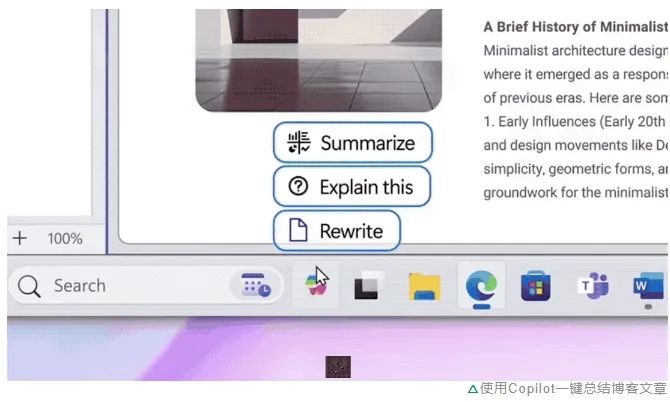

又比如,微软基于GPT-4打造的Copilot,已经全线入驻Win11,正式取代Cortana成为操作系统里的新一代AI助手。

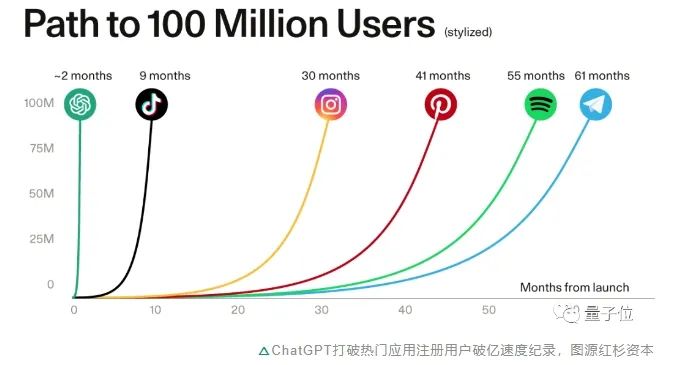

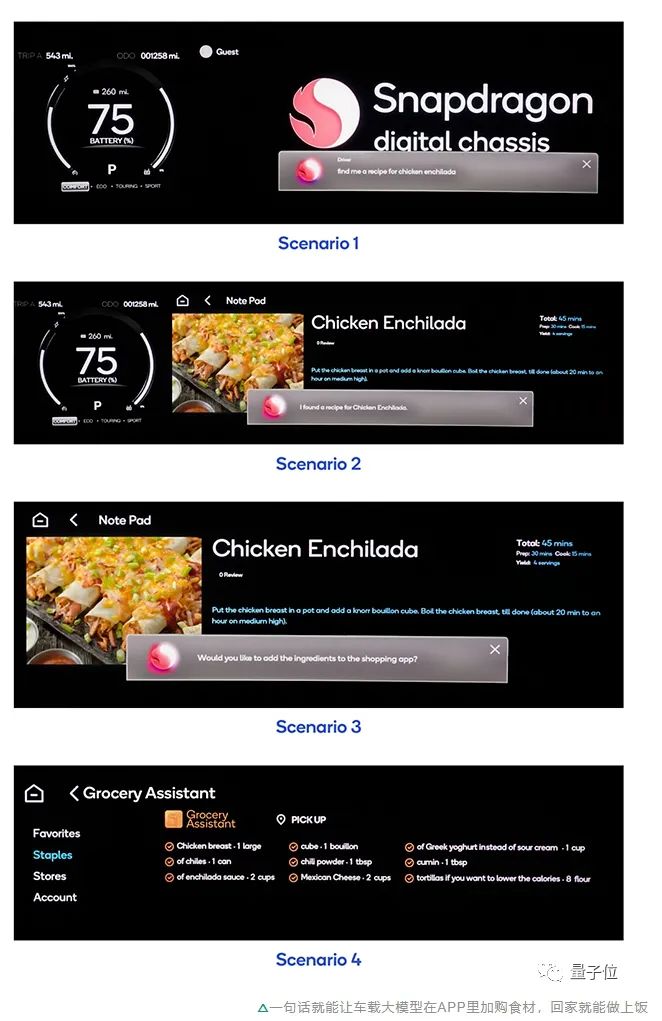

又比如,微软基于GPT-4打造的Copilot,已经全线入驻Win11,正式取代Cortana成为操作系统里的新一代AI助手。 再比如,国产汽车如极越01,已经在座舱中正式搭载大模型,而且是完全离线的那种……如果说,「大模型重塑一切」在2023年的3月份还只是一句技术先行者的乐观预言,到了今天,仍旧激烈的百模大战、以及实际的应用进展,已经让这一观点在行业内外激发越来越多的共鸣。换言之,大到整个互联网的生产方式,小到每一辆汽车中的智能座舱,一个以大模型为技术力底座、驱动千行百业自我革新的时代正在来临。按照蒸汽时代、电力时代的命名方式,或许能将之命名为「模力时代」。而在「模力时代」中,最受关注的场景之一,就是智能终端。原因很简单:以智能手机、PC、智能汽车甚至XR设备等为代表的智能终端产业,是与当代人生活最紧密相关的科技产业之一,自然也就成为了检验前沿技术成熟度的一个金标准。所以,当技术热潮带来的第一波炒作逐渐冷静,以智能终端场景为一个锚点,「模力时代」新的机遇和挑战应该如何去看待和解读?现在,是时候掰开揉碎,好好梳理一番了。智能终端,大模型新战场在具体分析挑战和机遇之前,还是先回到一个本质的问题上:大模型为代表的生成式AI为何会如此火爆,甚至被认为是“第四次工业革命”?针对这一现象,已经有不少机构在进行研究,试图预测或总结生成式AI在不同场景下的发展规律,如红杉资本的《Generative AI: A Creative New World》。在这其中,也有不少行业头部公司,基于自身经验分析了生成式AI在特定行业中的落地场景和潜在变革方向。如终端侧AI代表玩家高通,就在前段时间发布了关于生成式AI发展现状和趋势的白皮书《混合AI是AI的未来》。从中,或许能解读出生成式AI在行业中火爆的三大原因。首先,是技术本身足够硬核。无论是智能涌现的大模型,还是生成质量以假乱真的AI绘画,无不是用效果说话,实打实在几乎所有与文字、图像、视频和自动化相关的工作领域,展现出了颠覆传统工作流的惊人能力。其次,是潜在落地场景丰富。大模型所带来的AI代际式的突破,从一开始就带给了人们无穷的想象空间:最早的一批体验者,很快就感知到了生成式AI给工作带来的助益。用户侧庞大的需求,从ChatGPT等代表性应用的用户增速,就可见一斑。

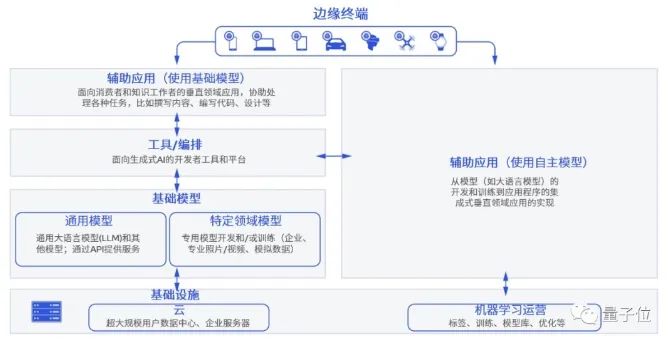

再比如,国产汽车如极越01,已经在座舱中正式搭载大模型,而且是完全离线的那种……如果说,「大模型重塑一切」在2023年的3月份还只是一句技术先行者的乐观预言,到了今天,仍旧激烈的百模大战、以及实际的应用进展,已经让这一观点在行业内外激发越来越多的共鸣。换言之,大到整个互联网的生产方式,小到每一辆汽车中的智能座舱,一个以大模型为技术力底座、驱动千行百业自我革新的时代正在来临。按照蒸汽时代、电力时代的命名方式,或许能将之命名为「模力时代」。而在「模力时代」中,最受关注的场景之一,就是智能终端。原因很简单:以智能手机、PC、智能汽车甚至XR设备等为代表的智能终端产业,是与当代人生活最紧密相关的科技产业之一,自然也就成为了检验前沿技术成熟度的一个金标准。所以,当技术热潮带来的第一波炒作逐渐冷静,以智能终端场景为一个锚点,「模力时代」新的机遇和挑战应该如何去看待和解读?现在,是时候掰开揉碎,好好梳理一番了。智能终端,大模型新战场在具体分析挑战和机遇之前,还是先回到一个本质的问题上:大模型为代表的生成式AI为何会如此火爆,甚至被认为是“第四次工业革命”?针对这一现象,已经有不少机构在进行研究,试图预测或总结生成式AI在不同场景下的发展规律,如红杉资本的《Generative AI: A Creative New World》。在这其中,也有不少行业头部公司,基于自身经验分析了生成式AI在特定行业中的落地场景和潜在变革方向。如终端侧AI代表玩家高通,就在前段时间发布了关于生成式AI发展现状和趋势的白皮书《混合AI是AI的未来》。从中,或许能解读出生成式AI在行业中火爆的三大原因。首先,是技术本身足够硬核。无论是智能涌现的大模型,还是生成质量以假乱真的AI绘画,无不是用效果说话,实打实在几乎所有与文字、图像、视频和自动化相关的工作领域,展现出了颠覆传统工作流的惊人能力。其次,是潜在落地场景丰富。大模型所带来的AI代际式的突破,从一开始就带给了人们无穷的想象空间:最早的一批体验者,很快就感知到了生成式AI给工作带来的助益。用户侧庞大的需求,从ChatGPT等代表性应用的用户增速,就可见一斑。 从最开始互联网的搜索、编程、办公,到现在涌现的文旅、法律、医药、工业、交通等等场景应用,乘生成式AI之风而起的,远不止能够提供基础大模型的公司,更是有一大批初创企业正顺势繁荣生长。有不少业内专家认为:对于创业者而言,大模型所带来的应用层的机会更大。底层有技术的代际式突破,上层有应用需求的蓬勃爆发,生态效应由此被激发。根据Bloomberg Intelligence预测,到2032年生成式AI市场规模将从400亿美元爆炸式增到1.3万亿美元,广泛覆盖生态链的各个参与方,包括基础设施、基础模型、开发者工具、应用产品、终端产品等等。

从最开始互联网的搜索、编程、办公,到现在涌现的文旅、法律、医药、工业、交通等等场景应用,乘生成式AI之风而起的,远不止能够提供基础大模型的公司,更是有一大批初创企业正顺势繁荣生长。有不少业内专家认为:对于创业者而言,大模型所带来的应用层的机会更大。底层有技术的代际式突破,上层有应用需求的蓬勃爆发,生态效应由此被激发。根据Bloomberg Intelligence预测,到2032年生成式AI市场规模将从400亿美元爆炸式增到1.3万亿美元,广泛覆盖生态链的各个参与方,包括基础设施、基础模型、开发者工具、应用产品、终端产品等等。 这种生态链的形成,推动了行业新的变革,有望让AI进一步成为底层核心生产力。基于这样的背景,我们再来看智能产业当下正在发生的事情。一方面,以大模型为代表的AIGC应用风暴,正在以天为单位的迭代节奏中迅速从云端走向终端。ChatGPT就率先在移动端更新了“视听说”的多模态功能,用户们拍照上传,就能针对照片内容与ChatGPT进行对话。高通也快速实现了在终端侧运行十几亿参数的Stable Diffusion和ControlNet大模型,在手机上生成高质量AI图像只需十几秒。不少手机厂商也已经宣布,要为自家语音助手装上大模型这个“大脑”。还不仅仅是手机。在上海车展、成都车展、慕尼黑车展等等国内外大型展会上,基础模型厂商和车厂的合作越来越常见,大模型“上车”已然成为智能座舱领域新的竞争点。

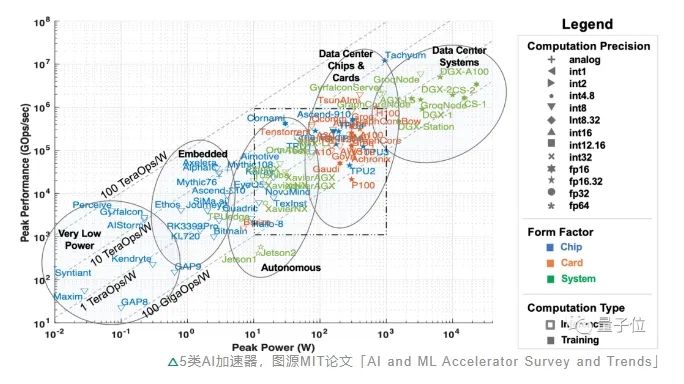

这种生态链的形成,推动了行业新的变革,有望让AI进一步成为底层核心生产力。基于这样的背景,我们再来看智能产业当下正在发生的事情。一方面,以大模型为代表的AIGC应用风暴,正在以天为单位的迭代节奏中迅速从云端走向终端。ChatGPT就率先在移动端更新了“视听说”的多模态功能,用户们拍照上传,就能针对照片内容与ChatGPT进行对话。高通也快速实现了在终端侧运行十几亿参数的Stable Diffusion和ControlNet大模型,在手机上生成高质量AI图像只需十几秒。不少手机厂商也已经宣布,要为自家语音助手装上大模型这个“大脑”。还不仅仅是手机。在上海车展、成都车展、慕尼黑车展等等国内外大型展会上,基础模型厂商和车厂的合作越来越常见,大模型“上车”已然成为智能座舱领域新的竞争点。 另一方面,应用的爆发加剧了算力供不应求的情况。可以预见的是,模型的推理成本将会随着日活用户数量及其使用频率的增加而增加,仅仅只依靠云端算力,是不足以快速推进生成式AI规模化的。从各行各业都在提升对终端侧AI算力的重视程度,也能看出这一点。例如终端侧AI玩家高通,针对PC端芯片性能提升发布了新一代PC计算平台,采用高通自研的Oryon CPU,尤其搭载的NPU将面向生成式AI提供更强大的性能,被命名为骁龙X系列平台。预计会在2023骁龙峰会上,这一新的计算平台就会发布。显然,无论从应用还是算力来看,智能终端都已经成为AIGC落地潜力最大的场景之一。AIGC潮涌下的暗礁事物通常具有两面性,大模型从快速发展到落地亦是如此。当生成式AI一路狂飙到今天,智能终端产业巨大潜力下的现实瓶颈,已经浮出水面。最大的掣肘之一,是最底层的硬件。正如红杉两位投资人Sonya Huang和Pat Grady最新一篇生成式AI分析文章《Generative AI’s Act Two》中所提到的,AIGC发展得很快,然而预料之中的瓶颈不在于客户需求,而在于供应端的算力。这里的算力,主要指AI和机器学习硬件加速器,从部署场景来看又可以被分为五大类:数据中心级系统、服务器级加速器、辅助驾驶&自动驾驶场景下的加速器、边缘计算和超低功耗加速器。

另一方面,应用的爆发加剧了算力供不应求的情况。可以预见的是,模型的推理成本将会随着日活用户数量及其使用频率的增加而增加,仅仅只依靠云端算力,是不足以快速推进生成式AI规模化的。从各行各业都在提升对终端侧AI算力的重视程度,也能看出这一点。例如终端侧AI玩家高通,针对PC端芯片性能提升发布了新一代PC计算平台,采用高通自研的Oryon CPU,尤其搭载的NPU将面向生成式AI提供更强大的性能,被命名为骁龙X系列平台。预计会在2023骁龙峰会上,这一新的计算平台就会发布。显然,无论从应用还是算力来看,智能终端都已经成为AIGC落地潜力最大的场景之一。AIGC潮涌下的暗礁事物通常具有两面性,大模型从快速发展到落地亦是如此。当生成式AI一路狂飙到今天,智能终端产业巨大潜力下的现实瓶颈,已经浮出水面。最大的掣肘之一,是最底层的硬件。正如红杉两位投资人Sonya Huang和Pat Grady最新一篇生成式AI分析文章《Generative AI’s Act Two》中所提到的,AIGC发展得很快,然而预料之中的瓶颈不在于客户需求,而在于供应端的算力。这里的算力,主要指AI和机器学习硬件加速器,从部署场景来看又可以被分为五大类:数据中心级系统、服务器级加速器、辅助驾驶&自动驾驶场景下的加速器、边缘计算和超低功耗加速器。 随着ChatGPT爆火,大模型带动AIGC现象级出圈,使得数据中心、服务器级处理器等“云端算力”短期受到大量关注,甚至出现供不应求的情况。然而,随着生成式AI迎来第二阶段,关于算力的一些问题也日渐凸显。首先也是最大的问题,在于成本。如高通《混合AI是AI的未来》白皮书所言,如今大半年过去,随着大模型从技术追逐转向应用落地,各公司的基础模型训练逐渐尘埃落定,算力的大部头落到大模型的推理上。短期内推理成本还可以接受,但随着大模型的APP越来越多、应用场景越来越广泛,在服务器等加速器上推理的成本也会急剧增加,最终导致调用大模型的成本比训练大模型本身还高。换言之,大模型进入第二阶段后,推理对算力的长期需求将会远远高于单次训练,仅仅依靠数据中心和服务器级处理器组成的“云端算力”,完全不足以将推理打到用户能够接受的成本。据高通在白皮书中统计,以加持大模型的搜索引擎为例,每一次搜索查询的成本,可以达到传统方法的10倍,每年光是在这方面的开销就可能增加数十亿美元。这注定会成为大模型落地的关键掣肘。随之而来的,还有时延、隐私和个性化问题。高通在《混合AI是AI的未来》中也提到,大模型直接部署在云端,除了用户量激增带来的服务器计算量不够,需要“排队使用”等bug,还势必需要解决用户隐私和个性化问题。如果用户不希望上传数据到云端,大模型的使用场景如办公、智能助手等,就会受到不少限制,而这些场景多数分布在终端侧;而如果需要进一步追求更好的效果,如定制大模型为己用,更是需要直接将个人信息用于大模型训练。种种因素之下,在推理上能发挥作用的“终端算力”,也就是包括自动驾驶&辅助驾驶、边缘计算(嵌入式)和超低功耗加速器在内的几大类处理器,开始进入人们的视野。终端潜藏着巨大的计算能力。据IDC预测,2025年全球物联网设备数将超过400亿台,产生数据量接近80ZB,超过一半的数据需要依赖终端或者边缘的计算能力进行处理。但终端同样存在功耗散热受限导致算力受限等问题。这种情况下,如何利用潜藏在终端的巨大算力,来突破云端算力发展面临的瓶颈,正在成为「模力时代」下的最普遍的技术难题之一。更别提除了算力以外,大模型落地还面临着算法、数据和市场竞争等挑战。对于算法而言,基础模型的架构依旧未知。ChatGPT固然已经取得了很好的成果,但其坚持的技术路线并非就是下一代模型的架构方向。对于数据而言,其他公司要想取得ChatGPT一般的大模型成果,高质量数据不可或缺,但《Generative AI’s Act Two》同样指出,目前应用公司生成的数据并没有创造一个真正的壁垒。靠数据建立起来的优势是脆弱且无法持续的,下一代基础模型很可能就能直接摧毁这堵“城墙”,相比之下,持续而稳定的用户才能真正构建数据来源。对于市场而言,目前大模型产品尚未出现多个杀手级应用,它究竟适配于何种场景仍旧未可知。在这个时代将它用于哪类产品之中、做出哪种应用能发挥它最大的价值,目前市场还没能给出一套能够沿袭的方法论或标准答案。更感兴趣的内容,请查看源文。

随着ChatGPT爆火,大模型带动AIGC现象级出圈,使得数据中心、服务器级处理器等“云端算力”短期受到大量关注,甚至出现供不应求的情况。然而,随着生成式AI迎来第二阶段,关于算力的一些问题也日渐凸显。首先也是最大的问题,在于成本。如高通《混合AI是AI的未来》白皮书所言,如今大半年过去,随着大模型从技术追逐转向应用落地,各公司的基础模型训练逐渐尘埃落定,算力的大部头落到大模型的推理上。短期内推理成本还可以接受,但随着大模型的APP越来越多、应用场景越来越广泛,在服务器等加速器上推理的成本也会急剧增加,最终导致调用大模型的成本比训练大模型本身还高。换言之,大模型进入第二阶段后,推理对算力的长期需求将会远远高于单次训练,仅仅依靠数据中心和服务器级处理器组成的“云端算力”,完全不足以将推理打到用户能够接受的成本。据高通在白皮书中统计,以加持大模型的搜索引擎为例,每一次搜索查询的成本,可以达到传统方法的10倍,每年光是在这方面的开销就可能增加数十亿美元。这注定会成为大模型落地的关键掣肘。随之而来的,还有时延、隐私和个性化问题。高通在《混合AI是AI的未来》中也提到,大模型直接部署在云端,除了用户量激增带来的服务器计算量不够,需要“排队使用”等bug,还势必需要解决用户隐私和个性化问题。如果用户不希望上传数据到云端,大模型的使用场景如办公、智能助手等,就会受到不少限制,而这些场景多数分布在终端侧;而如果需要进一步追求更好的效果,如定制大模型为己用,更是需要直接将个人信息用于大模型训练。种种因素之下,在推理上能发挥作用的“终端算力”,也就是包括自动驾驶&辅助驾驶、边缘计算(嵌入式)和超低功耗加速器在内的几大类处理器,开始进入人们的视野。终端潜藏着巨大的计算能力。据IDC预测,2025年全球物联网设备数将超过400亿台,产生数据量接近80ZB,超过一半的数据需要依赖终端或者边缘的计算能力进行处理。但终端同样存在功耗散热受限导致算力受限等问题。这种情况下,如何利用潜藏在终端的巨大算力,来突破云端算力发展面临的瓶颈,正在成为「模力时代」下的最普遍的技术难题之一。更别提除了算力以外,大模型落地还面临着算法、数据和市场竞争等挑战。对于算法而言,基础模型的架构依旧未知。ChatGPT固然已经取得了很好的成果,但其坚持的技术路线并非就是下一代模型的架构方向。对于数据而言,其他公司要想取得ChatGPT一般的大模型成果,高质量数据不可或缺,但《Generative AI’s Act Two》同样指出,目前应用公司生成的数据并没有创造一个真正的壁垒。靠数据建立起来的优势是脆弱且无法持续的,下一代基础模型很可能就能直接摧毁这堵“城墙”,相比之下,持续而稳定的用户才能真正构建数据来源。对于市场而言,目前大模型产品尚未出现多个杀手级应用,它究竟适配于何种场景仍旧未可知。在这个时代将它用于哪类产品之中、做出哪种应用能发挥它最大的价值,目前市场还没能给出一套能够沿袭的方法论或标准答案。更感兴趣的内容,请查看源文。4. 忆阻器存算一体芯片新突破!有望促进人工智能、自动驾驶等领域发展

原文:https://mp.weixin.qq.com/s/2BbWRjpu_lreG6TEiG0XKw电子发烧友网报道(文/李弯弯)近日,清华大学集成电路学院教授吴华强、副教授高滨团队基于存算一体计算范式,研制出全球首颗全系统集成的、支持高效片上学习的忆阻器存算一体芯片,在支持片上学习的忆阻器存算一体芯片领域取得重大突破。该芯片包含支持完整片上学习所必需的全部电路模块,成功完成图像分类、语音识别和控制任务等多种片上增量学习功能验证,展示出高适应性、高能效、高通用性、高准确率等特点,有效强化智能设备在实际应用场景下的学习适应能力,有望促进人工智能、自动驾驶、可穿戴设备等领域的发展。什么是忆阻器忆阻器,全称记忆电阻器(Memristor)。它是表示磁通与电荷关系的电路器件。忆阻具有电阻的量纲,但和电阻不同的是,忆阻的阻值是由流经它的电荷确定。因此,通过测定忆阻的阻值,便可知道流经它的电荷量,从而有记忆电荷的作用。1971年,蔡少棠从逻辑和公理的观点指出,自然界应该还存在一个电路元件,它表示磁通与电荷的关系。2008年,惠普公司的研究人员首次做出纳米忆阻器件,掀起忆阻研究热潮。纳米忆阻器件的出现,有望实现非易失性随机存储器。并且,基于忆阻的随机存储器的集成度、功耗、读写速度都要比传统的随机存储器优越。此外,忆阻是硬件实现人工神经网络突触的最好方式。2012年,比勒菲尔德大学托马斯博士及其同事制作出一种具有学习能力的忆阻器。2013年,安迪·托马斯利用这种忆阻器作为人工大脑的关键部件,他的研究结果发表在《物理学学报D辑:应用物理学》杂志上。安迪·托马斯解释说,因为忆阻器与突触的这种相似性,使其成为制造人工大脑——从而打造出新一代电脑——的绝佳材料,“它使我们得以建造极为节能、耐用,同时能够自学的处理器。”托马斯的文章总结了自己的实验结果,并借鉴其他生物学和物理学研究的成果,首次阐述了这种仿神经系统的电脑如何将自然现象转化为技术系统,及其中应该遵循的几个原则。这些原则包括,忆阻器应像突触一样,“注意”到之前的电子脉冲;而且只有当刺激脉冲超过一定的量时,神经元才会做出反应,忆阻器也是如此。在国内,钱鹤、吴华强团队2012年开始研究用忆阻器来做存储,但由于忆阻器的材料器件优化和集成工艺不成熟,团队只能靠自己在实验室里摸索,在一次次失败的实验中探索提高器件的一致性和良率。两年后,清华大学与中科院微电子所、北京大学等单位合作,优化忆阻器的器件工艺,制备出高性能忆阻器阵列,成为我国率先实现忆阻器阵列大规模集成的重要基础。基于忆阻器的新型存算一体架构近些年,随着人工智能应用对计算和存储需求的不断提升,集成电路芯片技术面临诸多新挑战。一方面,摩尔定律“渐行渐远”,通过集成电路工艺微缩的方式获得算力提升越来越难;另一方面,计算与存储在不同电路单元中完成,会造成大量数据搬运的功耗,增加延迟。如何用计算存储一体化突破AI算力瓶颈,成为近年来国内外的科研热点。过去很多年里,学术界和产业界探索了多种用于实现存算一体的硬件,忆阻器被认为是极具前景的器件之一。吴华强教授此前谈到,基于忆阻器的新型存算一体架构,可以打破算力瓶颈,满足人工智能等复杂任务对计算硬件的高需求。不过,想让忆阻器阵列实现芯片的功能,还需解决器件、系统、算法等方面的瓶颈。吴华强表示,忆阻器固有的非理想特性,例如器件间波动、器件电导卡滞、电导状态漂移等,会导致计算准确率降低;此外,在架构方面,忆阻器阵列实现卷积功能需要以串行滑动的方式连续采样、计算多个输入块,无法匹配全连接结构的计算效率。从最新的研究成果来看,吴华强团队似乎解决了这些困难。该团队创新设计出适用于忆阻器存算一体的高效片上学习的新型通用算法和架构,研制出全球首颗全系统集成的、支持高效片上学习的忆阻器存算一体芯片。相同任务下,该芯片实现片上学习的能耗仅为先进工艺下专用集成电路(ASIC)系统的3%,展现出卓越的能效优势,极具满足人工智能时代高算力需求的应用潜力,为突破冯·诺依曼传统计算架构下的能效瓶颈提供了一种创新发展路径。吴华强介绍,存算一体片上学习在实现更低延迟和更低能耗的同时,能够有效保护用户隐私和数据。该芯片参照仿生类脑处理方式,可实现不同任务的快速“片上训练”与“片上识别”,能够有效完成边缘计算场景下的增量学习任务,以极低的耗电适应新场景、学习新知识,满足用户的个性化需求。小结近几年,人工智能技术的发展对算力的需求越来越高,同时传统计算架构的瓶颈也越来越明显,学术界和产业界都在积极探索新的发展模式来解决这一问题,存算一体技术凭借突出的能效比优势脱颖而出。而在实现存算一体的各类器件中,忆阻器的先天优势明显。此次清华大学研制出支持片上学习的忆阻器存算一体芯片,意义重大。

5. 美国AI芯片出口管制再升级,A800/H800禁止对大陆出口,国产GPU发展势在必行!

原文:https://mp.weixin.qq.com/s/1snqc5TKjPajcUz4ELIO6w10月17日,美国商务部工业与安全局(BIS)发布更新针对人工智能(AI)芯片的出口管制规定。该计划不仅限制英伟达等公司向中国出口先进的AI芯片,还可能阻碍ASML、应用材料、泛林和KLA等向中国销售和出口半导体制造设备。与此同时,BIS周二还在《联邦公报》刊登了一份定于10月19日发布的行政措施,准备将13家中国公司添加到出口管制名单,即所谓的“实体清单”。其中包括北京壁仞科技开发有限公司、摩尔线程智能科技(北京)有限责任公司两家中国GPU企业。英伟达A100 / A800 / H100 / H800 / L40 / L40S / RTX 4090等产品都将受限美国商务部长吉娜·雷蒙多(Gina Raimondo)称,新措施填补了去年10月发布法规中的漏洞,并表示这些措施未来可能至少每年更新一次。她表示,美国限制的目标是阻止中国获得先进的半导体,这些半导体可能推动中国人工智能和精密计算机的突破。去年10月,美国对出口中国的AI芯片实施带宽速率限制。根据当时英伟达发布的公告,美国通知该公司向中国出口A100和H100芯片将需要新的许可证要求,同时DGX或任何其他包含A100或H100芯片的产品,以及未来性能高于A100的芯片都将受到新规管制。A100是英伟达2020年推出的数据中心级云端加速芯片,支持FP16、FP32和FP64浮点运算,为人工智能、数据分析和HPC数据中心等提供算力。H100是英伟达2022年推出的最新一代数据中心GPU,H100在FP16、FP32和FP64计算上比A100快三倍,非常适用于当下流行且训练难度高的大模型。当时国内高端场景基本采用英伟达的A100,不少主流厂商也预定了计划在2022年下半年发货的H100。然而美国政府去年10月发布的法规,让这些厂商在一些高端应用上面临无合适芯片可用的局面。不过之后,英伟达向中国企业提供了替代版本A800和H800,用以解决美国商务部的半导体出口新规。根据美国商务部去年10月的发布的法规,主要限制的是显卡的算力和带宽,算力上线是4800 TOPS,带宽上线是600 GB/s。英伟达新发布的A800的带宽为400GB/s,低于A100的600GB/s,H800虽然参数未公布,但据透露只约到H100(900 GB/s)的一半。这意味着A800、H800在进行AI模型训练的时候,需要耗费更长的时间,不过相对来说,也已经很好了。然而,尽管A800、H800对关键性能进行了大幅限制。但美国政府认为,H800在某些情况下算力仍然不亚于H100。为了进一步加强对AI芯片的出口管制,美国计划用多项新的标准来替换掉之前针对“带宽参数”(Bandwidth Parameter)提出的限制,尽管这已经大大降低了AI芯片之间的通信速率,增加了AI开发的难度和成本。根据新规,美国商务部计划引入一项被称为“性能密度”(performance density)的参数,来防止企业寻找到变通的方案,修订后的出口管制措施将禁止美国企业向中国出售运行速度达到300 teraflops(即每秒可计算 3亿次运算)及以上的数据中心芯片。新措施还旨在防止企业通过Chiplet的芯片堆叠技术绕过芯片限制。针对美国政府此次发布的新规,英伟达公司依规发布了8-K文件,对出口管制做出了解释。英伟达称,此次出口管制涉及的产品包括但不限于:A100、A800、H100、H800、L40、L40S 以及RTX 4090。任何集成了一个或多个以上芯片的系统,包括但不限于英伟达DGX、HGX系统,也在新规涵盖范围之内。此外,美国政府还将要求企业获得向40多个国家/地区出售芯片的许可证,以防止中国企业从海外其他国家和地区获得先进芯片。美国政府还对中国以外的21个国家提出了芯片制造设备的许可要求,并扩大了禁止进入这些国家和地区的设备清单。同时,美国还将13家中国公司添加到出口管制名单,其中,壁仞科技、摩尔线程两家GPU企业在列。发展国产GPU等大算力芯片势在必行美国政府此次对人工智能芯片的出口管制升级,对中国相关产业发展有何影响?中国主要的互联网大厂、云服务厂商基本都依赖英伟达的GPU。尤其是近年来随着ChatGPT的出圈,国内各大互联网公司、AI企业都在大力自研AI大模型产品,这更是加大了对英伟达GPU的需求。由于去年A100就已经被禁,今年上半年各大互联网厂商都在争相采购A800。不过从目前的情况来看,新规对各大厂商短期的影响倒是不明显。多家厂商对媒体表示,已经提前接到消息,不少厂商已经预先进行囤货。一家服务器厂商的内部人士表示,公司囤了足够的量。腾讯、百度等大厂也囤货充足。一家上市公司17日晚间发布公告称,其控股子公司向其供应商采购了75台H800及22台A800现货。该公司对媒体表示,已经在两周前就解决了这个问题。国内一些大模型创业企业也已经提前做了准备,比如智谱AI,该公司表示公司囤货充足。不过依靠囤货毕竟不是长久之计,有厂商表示,虽然吞了足够的量,不过未来还是有很大压力。美国此次新规的发布意味着其对我国算力的进一步遏制,这对如今备受重视的大模型的发展也将会有所限制。从长远来看,国产GPU等大算力芯片的发展才是关键。事实上,过去这些年美国不断升级出口管制,国内企业已经逐步倾向于采用***,国内的芯片企业也在政策的支持下,下游企业更多的采用下,技术和产品也得到更多迭代,发展越来越好。比如,智谱AI虽然屯了足够的芯片,同时它也为配合国产GPU发展,同步落地GLM(通用语言模型)***适配计划,可适配10余种***等。当前,国内已经有一些芯片可以支持大模型的训练和推理,长此发展下去,未来的性能、生态也一定会越来越成熟。从美国此次新规将壁仞科技、摩尔线程等公司列入实体清单,可以看出美国对中国GPU芯片快速发展的担忧。当然这也意味着,未来中国大算力芯片的进一步突破,也将面临着更大的困难,这需要设备、制造等产业链各环节的同步升级。小结为了阻止中国先进技术的发展,美国无休止的实施出口管制。这确实在短期内阻碍了一些企业的发展,不过从过去几年的情况来看,美国的出口限制,也进一步促进了中国芯片产业的发展。未来,中国企业也同样会不断进行探索,以应对美方的打压。除了对中国企业造成影响之外,美方不当管制严重阻碍了各国芯片及芯片设备、材料、零部件企业正常经贸往来,严重破坏了市场规则和国际经贸秩序,威胁到全球产业链供应链稳定。美国自己的企业也损失巨大,比如英伟达,虽然该公司表示短期内财务业务新规影响较小,但是要知道其接近50%的收入来自中国,此次新规将几乎阻断英伟达大部分中国业务的开展。除此之外,因为美国的不当管制,其他国家的半导体企业也深受其害。

6. 超火迷你GPT-4视觉能力暴涨,GitHub两万星,华人团队出品

原文:https://mp.weixin.qq.com/s/nG3otCtN1mwSHKXEw-0vxwGPT-4V来做目标检测?网友实测:还没有准备好。

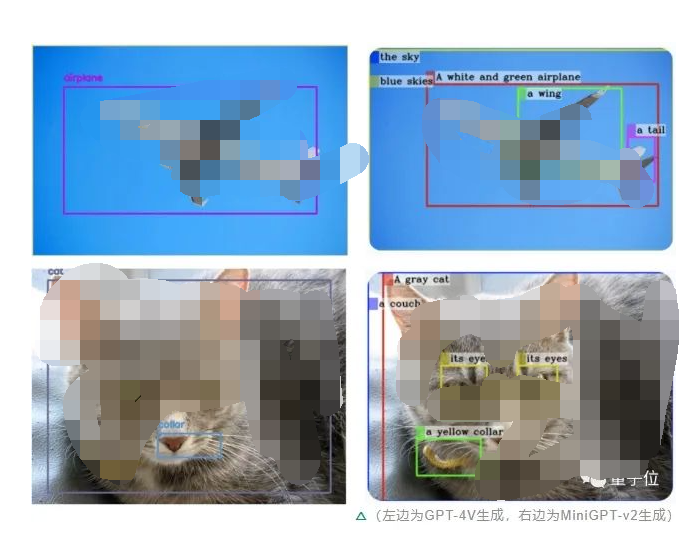

虽然检测到的类别没问题,但大多数边界框都错放了。没关系,有人会出手!那个抢跑GPT-4看图能力几个月的迷你GPT-4升级啦——MiniGPT-v2。

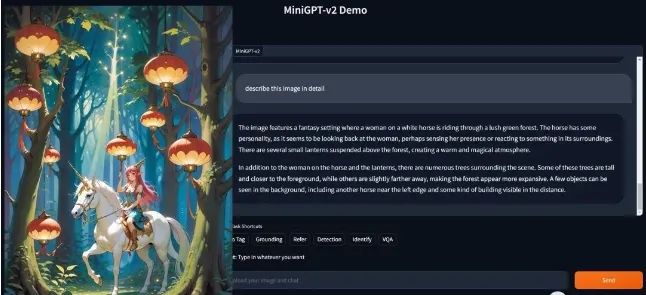

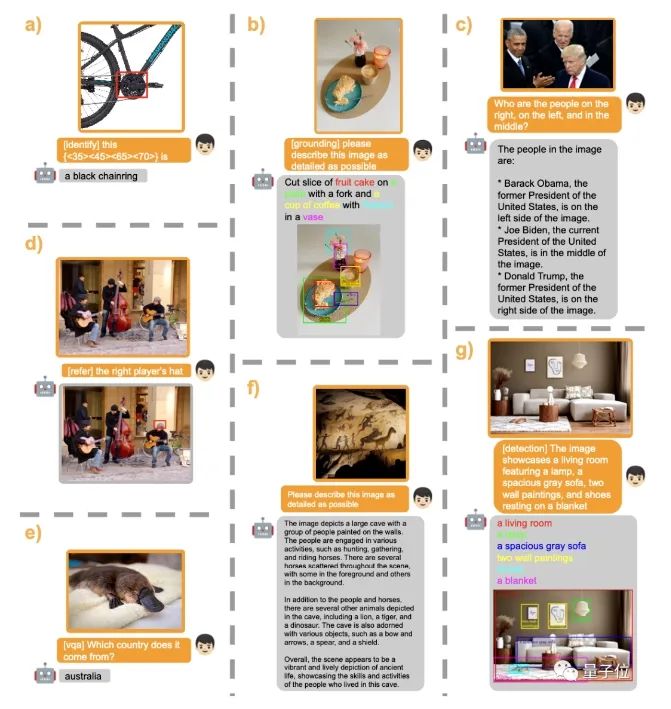

虽然检测到的类别没问题,但大多数边界框都错放了。没关系,有人会出手!那个抢跑GPT-4看图能力几个月的迷你GPT-4升级啦——MiniGPT-v2。 而且只是一句简单指令:[grounding] describe this image in detail就实现的结果。不仅如此,还轻松处理各类视觉任务。圈出一个物体,提示词前面加个 [identify] 可让模型直接识别出来物体的名字。

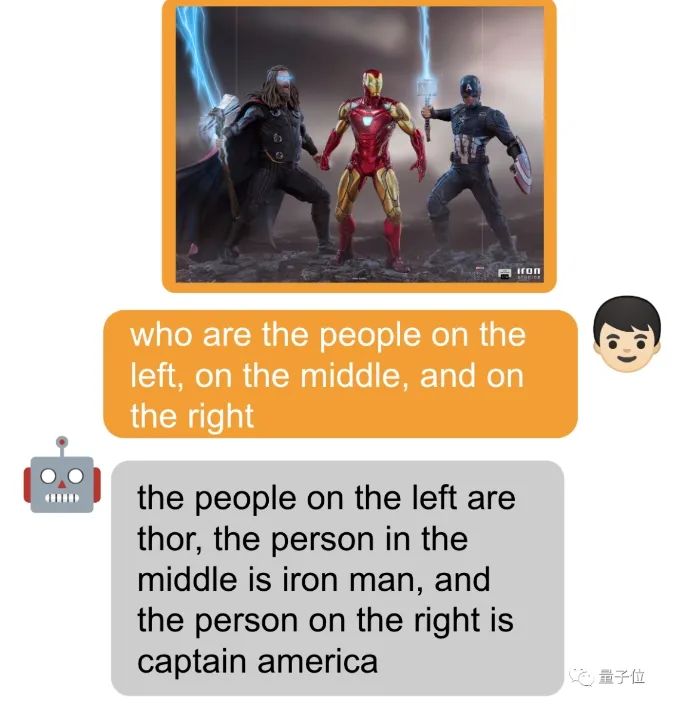

而且只是一句简单指令:[grounding] describe this image in detail就实现的结果。不仅如此,还轻松处理各类视觉任务。圈出一个物体,提示词前面加个 [identify] 可让模型直接识别出来物体的名字。 当然也可以什么都不加,直接问~

当然也可以什么都不加,直接问~ MiniGPT-v2由来自MiniGPT-4的原班人马(KAUST沙特阿卜杜拉国王科技大学)以及Meta的五位研究员共同开发。

MiniGPT-v2由来自MiniGPT-4的原班人马(KAUST沙特阿卜杜拉国王科技大学)以及Meta的五位研究员共同开发。 上次MiniGPT-4刚出来就引发巨大关注,一时间服务器被挤爆,如今GItHub项目已超22000+星。

上次MiniGPT-4刚出来就引发巨大关注,一时间服务器被挤爆,如今GItHub项目已超22000+星。 此番升级,已经有网友开始用上了~

此番升级,已经有网友开始用上了~ 多视觉任务的通用界面大模型作为各文本应用的通用界面,大家已经司空见惯了。受此灵感,研究团队想要建立一个可用于多种视觉任务的统一界面,比如图像描述、视觉问题解答等。

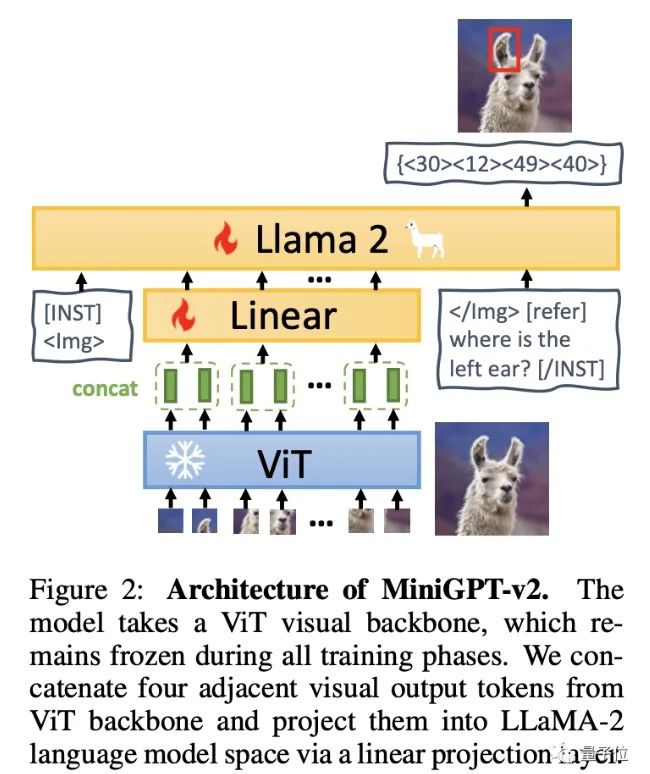

多视觉任务的通用界面大模型作为各文本应用的通用界面,大家已经司空见惯了。受此灵感,研究团队想要建立一个可用于多种视觉任务的统一界面,比如图像描述、视觉问题解答等。 「如何在单一模型的条件下,使用简单多模态指令来高效完成各类任务?」成为团队需要解决的难题。简单来说,MiniGPT-v2由三个部分组成:视觉主干、线性层和大型语言模型。

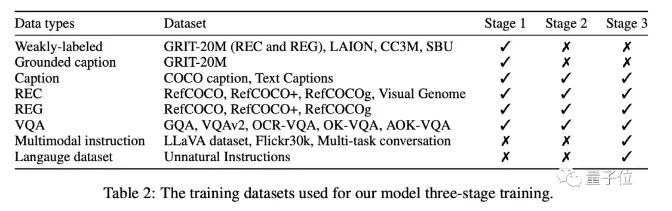

「如何在单一模型的条件下,使用简单多模态指令来高效完成各类任务?」成为团队需要解决的难题。简单来说,MiniGPT-v2由三个部分组成:视觉主干、线性层和大型语言模型。 该模型以ViT视觉主干为基础,所有训练阶段都保持不变。从ViT中归纳出四个相邻的视觉输出标记,并通过线性层将它们投影到 LLaMA-2语言模型空间中。团队建议在训练模型为不同任务使用独特的标识符,这样一来大模型就能轻松分辨出每个任务指令,还能提高每个任务的学习效率。训练主要分为三个阶段:预训练——多任务训练——多模式指令调整。

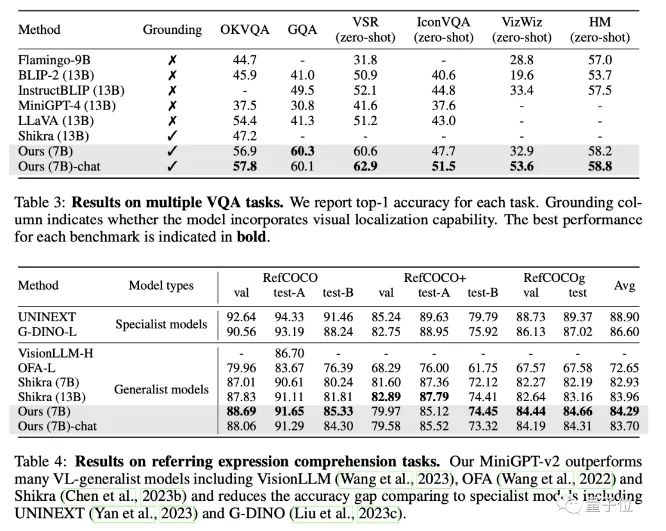

该模型以ViT视觉主干为基础,所有训练阶段都保持不变。从ViT中归纳出四个相邻的视觉输出标记,并通过线性层将它们投影到 LLaMA-2语言模型空间中。团队建议在训练模型为不同任务使用独特的标识符,这样一来大模型就能轻松分辨出每个任务指令,还能提高每个任务的学习效率。训练主要分为三个阶段:预训练——多任务训练——多模式指令调整。 最终,MiniGPT-v2 在许多视觉问题解答和视觉接地基准测试中,成绩都优于其他视觉语言通用模型。

最终,MiniGPT-v2 在许多视觉问题解答和视觉接地基准测试中,成绩都优于其他视觉语言通用模型。 最终这个模型可以完成多种视觉任务,比如目标对象描述、视觉定位、图像说明、视觉问题解答以及从给定的输入文本中直接解析图片对象。

最终这个模型可以完成多种视觉任务,比如目标对象描述、视觉定位、图像说明、视觉问题解答以及从给定的输入文本中直接解析图片对象。 感兴趣的朋友,可戳下方Demo链接体验:https://minigpt-v2.github.io/https://huggingface.co/spaces/Vision-CAIR/MiniGPT-v2论文链接:https://arxiv.o?rg/abs/2310.09478GitHub链接:https://github.com/Vision-CAIR/MiniGPT-4参考链接:https://twitter.com/leoyerrrr

感兴趣的朋友,可戳下方Demo链接体验:https://minigpt-v2.github.io/https://huggingface.co/spaces/Vision-CAIR/MiniGPT-v2论文链接:https://arxiv.o?rg/abs/2310.09478GitHub链接:https://github.com/Vision-CAIR/MiniGPT-4参考链接:https://twitter.com/leoyerrrr

———————End———————

点击阅读原文进入官网

原文标题:【AI简报20231020期】出自华人之手:DALL-E 3论文公布、上线ChatGPT!超火迷你GPT-4

文章出处:【微信公众号:RTThread物联网操作系统】欢迎添加关注!文章转载请注明出处。

-

RT-Thread

+关注

关注

32文章

1440浏览量

42358

原文标题:【AI简报20231020期】出自华人之手:DALL-E 3论文公布、上线ChatGPT!超火迷你GPT-4

文章出处:【微信号:RTThread,微信公众号:RTThread物联网操作系统】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

OpenAI或在周五凌晨发布GPT-5 OpenAI以低价向美国政府提供ChatGPT

AI真会人格分裂!OpenAI最新发现,ChatGPT善恶开关已开启

树莓派 也能搞 AI 艺术?树莓派遇上DALL-E,开启你的 AI 艺术创作之旅!

从性能到商业,Grok3、GPT-4o、DeepSeek如何重塑AI版图?

OpenAI简化大模型选择:萨姆·奥特曼制定路线图

ChatGPT Plus 2025新功能抢先看:如何订阅与使用全攻略

OpenAI即将发布GPT-4.5与GPT-5

OpenAI将发布更智能GPT模型及AI智能体工具

一文说清楚什么是AI大模型

【AI简报20231020期】出自华人之手:DALL-E 3论文公布、上线ChatGPT!超火迷你GPT-4

【AI简报20231020期】出自华人之手:DALL-E 3论文公布、上线ChatGPT!超火迷你GPT-4

评论