电子发烧友网报道(文/李弯弯)近日消息,美国考虑进一步限制向中国出口AI芯片,商务部最早可能在下个月初采取行动。在没有获得许可证的情况下,美商务部将禁止英伟达等制造商向中国客户运送AI芯片。英伟达专供中国的A800芯片,在无许可证的情况下也将被禁售。

A800是英伟达专为中国客户推出的产品,用以解决美国商务部的半导体出口新规,取代A100 GPU,该产品在2022年第三季度起投产。近段时间,大模型迅猛发展,国内在新规之前采购的可流通A100并不多,目前各互联网厂商争相采购的主要是A800。

A800被禁售,国内AI大模型训练受阻?

在AI大模型的训练上,现在基本上是用英伟达的A100、H100以及特供中国的减配版 A800、H800。2020年和2022年,英伟达先后推出了A100芯片、H100芯片,其中A100显卡又提供80GB、40GB两个显存版本,H100则提供80GB显存。

A100拥有540亿晶体管,采用台积电7nm工艺制程,支持FP16、FP32和FP64浮点运算,为人工智能、数据分析和HPC数据中心等提供算力。

H100集成800亿晶体管,采用台积电定制的4nm工艺,相比于A100,H100在FP16、FP32和FP64计算上比A100快三倍,非常适用于当下流行且训练难度高的大模型。

2022年9月,美国商务部对GPU 的出口规定,主要限制是显卡的算力和带宽,算力上线是4800 TOPS,带宽上线是600 GB/s。A800的带宽为400GB/s,低于A100的600GB/s,H800的参数并未公布,据知情人士透露只有H100(900 GB/s)到约一半。

这意味着A800、H800在进行AI模型训练的时候,需要耗费更长的时间,不过这相比于其他的同类产品,性能仍然是高的。

最近大半年时间,随着ChatGPT的出圈,国内外各大互联网公司、AI企业都在大力研发自己的AI大模型产品,而这也造成了对GPU的极大需求。各大互联网厂商都在大力采购英伟达的GPU芯片,包括百度、阿里、腾讯、字节跳动等等。

在国内,还可流通的A100并不多,据一家服务器定制企业的销售经理描述,需求太过火爆,甚至有人从机房里把芯片禁运政策生效前购买的A100 80GB拆出来倒卖。

如今,国内市场还是主要倚赖在政策允许范围内的A800芯片。不过大模型火爆之后,因为需求太大,A800也出现供货周期拉长、价格上涨的情况,据业内人士透露,之前两周时间就能到货,现在乐观的情况也要4-6周的时间,甚至更长。

如今,根据美国商务部的意思,A800在无许可证的情况下将被禁售,这意味着,后续国内企业在大模型的研究中,不仅仅是买到A800需要更长时间的问题,而是很可能买不到的问题。而且不仅仅是A800,其他AI芯片向中国的销售也可能受阻,包括原本也可以用于一些模型训练,性能较差一些的V100等。这意味着,国内企业AI大模型后续的训练将受阻。

国产GPU能否挑大梁?

如此看来,国内AI后续的发展,它对算力的需求似乎就只能指望国产GPU了。目前国产GPU的情况如何呢?

大模型训练需要处理高颗粒度的信息,对云端训练芯片的芯片处理信息的精细度和算力速度要求更高,现阶段国产GPU大多数不具备支撑大模型训练所需的能力。

不同于多媒体和图形处理的单精度浮点计算(FP32)计算需求,在超算领域,双精度浮点计算能力FP64是进行高算力计算的硬性指标。

目前国内GPU芯片的云端训练公司,大多只能处理单精度浮点计算,如壁仞科技(通用GPU芯片BR100)、天数智芯(“智铠100”)、寒武纪(云端推理思元270)的产品在FP32的理论指标上做得不错,但没有处理FP64的能力。

所以说,从短期来看,国产的GPU产品还难以支撑起AI大模型的训练,这意味着英伟达A800芯片被禁售,国内AI大模型接下来的研究将难以为继。

那是不是说,无论是国内的AI大模型企业,还是国产的GPU企业,真的就束手无策了?也并不是。据业内人士介绍,对于算力的需求主要与模型参数有关,大厂现在所做的通用大模型依然只能使用英伟达的产品。但是,垂类行业的大模型(金融、医疗等)或者参数量不像GPT那样大的模型,一些国产GPU也能够做到。

比如,国内某短视频平台参数量约为1000亿的大模型,就用了寒武纪的产品,做训练和推理。当然该模型训练使用了英伟达的A100。

此外,今年6月10日,天数智芯对外宣布,在天垓100加速卡的算力集群,基于北京智源人工智能研究院70亿参数的Aquila语言基础模型,使用代码数据进行继续训练,稳定运行19天,模型收敛效果符合预期,证明天数智芯有支持百亿级参数大模型训练的能力。

摩尔学院院长李丰此前对媒体表示,公司已经可以支持3亿参数量模型的训练。

首都在线表示,公司与燧原科技联合开发的AIGC模型方案已发布内测,产品可以从容应对前期投入大、算力要求高、算法模型快速迭代创新的需求,并广泛支持文本、语音、视觉等各技术方向的模型训练。

可见,目前国产GPU虽然在参数量较大的模型训练上存在不足,但是确实已经能够在一些中小参数模型的训练上有所作为。

登临科技联合创始人王平此前对媒体表示,相比于国际领先的GPU产品,国产GPU确实在满足大模型训练上存在差距,因为此前行业在产品定义上未朝大模型方向做设计。

而现在国产GPU公司都在朝着大模型方向去布局,相信未来终能够找到方向,进行突破。而且如今A800在无许可证的情况下如果禁售,这对于国产GPU的发展将会有强大的刺激作用,因为如果不突破,意味着国内未来AI大模型的发展将无计可施,这似乎成了唯一的出路。

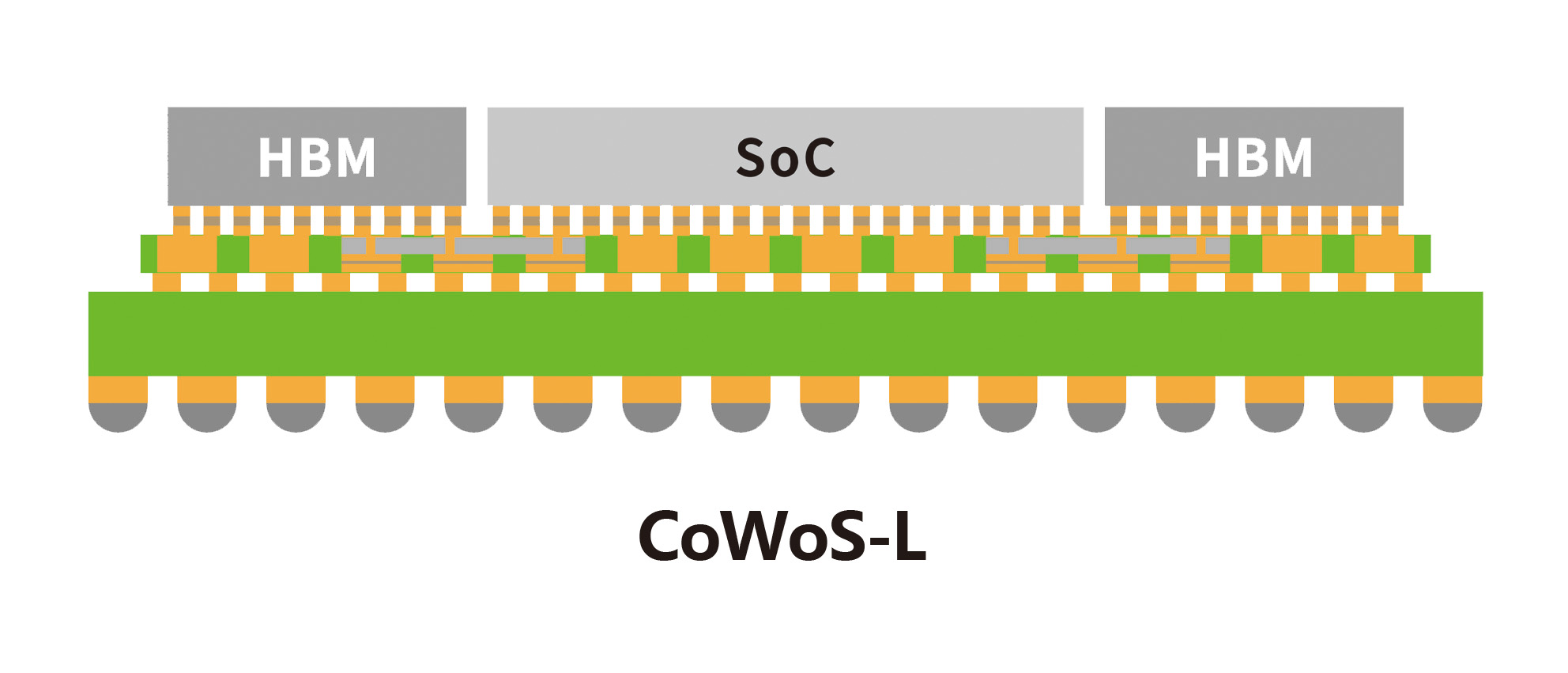

目前业界正在做相关的探索,比如,思考能否通过Chiplet、先进封装的方式提高算力。研究如何提升芯片与芯片间的数据传输速度等。昆仑芯就表示,相较于第一代产品,昆仑芯2在算力、互联上都有大幅优化,公司正在不断研发新的产品和技术,以满足ChatGPT等大模型的应用需求。

小结

很显然,在A100、H100之后,若A800在无许可证下被禁售,意味着国内AI大模型后续的训练将无GPU可用。目前而言国产GPU几乎还不能用于较大规模参数模型的训练。不过可以看到,一些产品在较小规模,比如几亿、甚至百亿级别参数规模的模型训练上,已经可以有所作为。而且目前众厂商都在朝着大模型应用方向进行探索,从长远来看,必然会逐步取得进展。

-

AI

+关注

关注

88文章

35757浏览量

282423 -

英伟达

+关注

关注

22文章

3973浏览量

94354 -

A800

+关注

关注

0文章

14浏览量

355

发布评论请先 登录

英伟达黄仁勋:将向中国市场销售H20芯片 中国市场至关重要

英伟达拟再推中国特供GPU,今年6月量产!

特朗普要叫停英伟达对华特供版 英伟达H20出口限制 或损失55亿美元

英伟达、高通布局AI投资版图,这些明星企业被收入囊中!

英伟达杀疯了!Blackwell横扫市场,AMD、英特尔加入降本浪潮

英伟达A800芯片也要被禁售了?中国AI大模型还能怎么玩?国产GPU能否挑大梁

英伟达A800芯片也要被禁售了?中国AI大模型还能怎么玩?国产GPU能否挑大梁

评论