作者 | BDJ

小编 | CACTUS

“每次版本迭代,测试团队总是最晚下班的一群人...”

在汽车软件快速迭代的今天,这样的场景已成为行业常态:开发效率不断提升,但测试环节却逐渐成为拖慢交付的“最后一公里”。复杂的工具链、割裂的流程、模糊的能力评估标准,让测试团队陷入"救火式加班"的循环。

更令人焦虑的是——

管理层难以量化测试团队的真实能力水平;

工程师说不清效率瓶颈究竟在哪里;

工具投入不少,但效果始终达不到预期;

问题的本质在于:

汽车测试行业缺失一个统一的“测试效率坐标系”。当每个团队都用各自的方式评估能力时,就像用不同的尺子丈量高度,无法得出客观结论。

这个困局终于有了解决方案。

ATEF:破解测试效率难题的开放框架

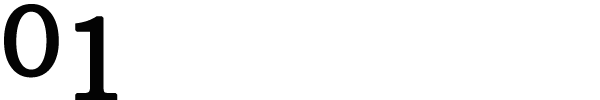

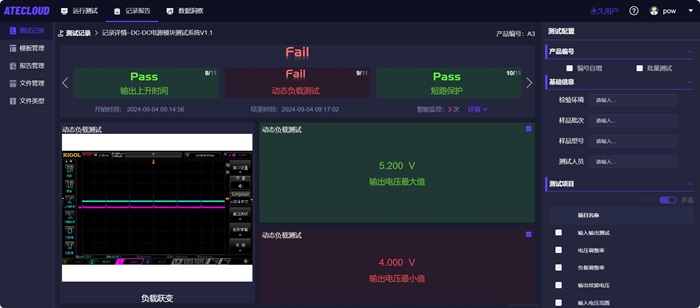

ATEF(Automotive Testing Efficiency Framework)是 Synopsys(新思) 提出的一套开放的、基于能力的参考模型,通过34?项测试能力(如自动化、追踪性、复用度、可维护性和 CI/CD 程度)的分级(L0–L4),帮助团队量化当前测试能力、识别瓶颈,并提供改进建议,用表格引导评估与优化测试系统效率的框架。

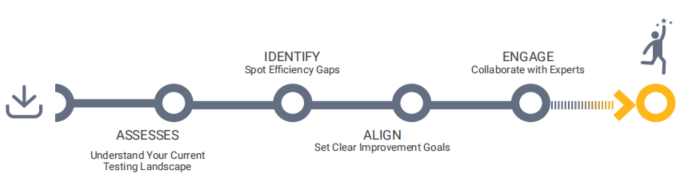

ATEF并不定义测试如何进行,而是揭示测试在团队中的实际运行方式,以及影响其效率因素。其核心目标是:识别瓶颈和优势、发掘改进潜力,从而推动高效可持续的进步。

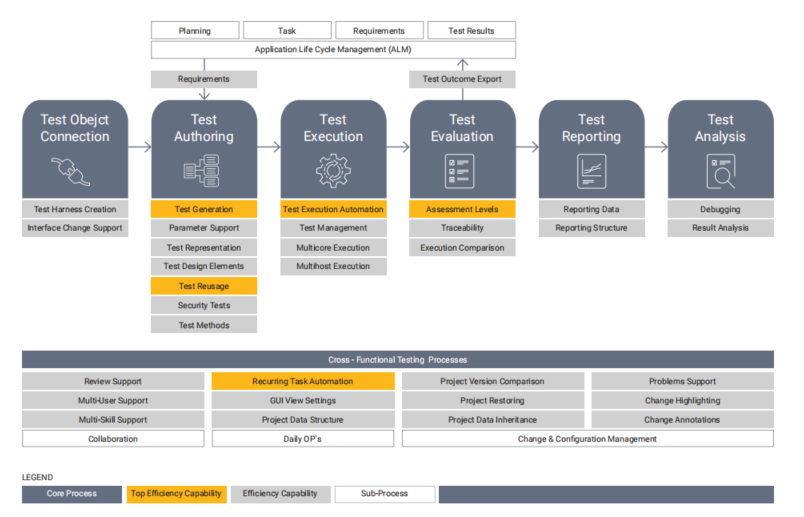

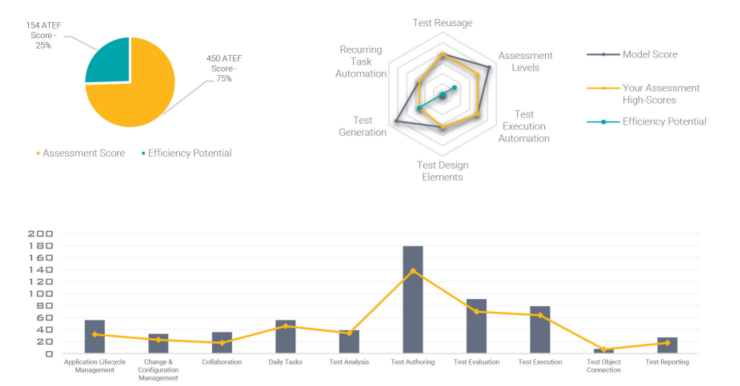

图 1 ATEF评估过程

ATEF评估原则

为了确保ATEF正常进行,需遵守如下原则:

ATEF评分维度

ATEF框架将测试过程分解为多个核心结构要素,每个要素聚焦测试效率的关键指标。结构要素中划分多个成熟度等级,系统描述从基础到高级的测试能力演进路径。

图 2 ATEF能力矩阵

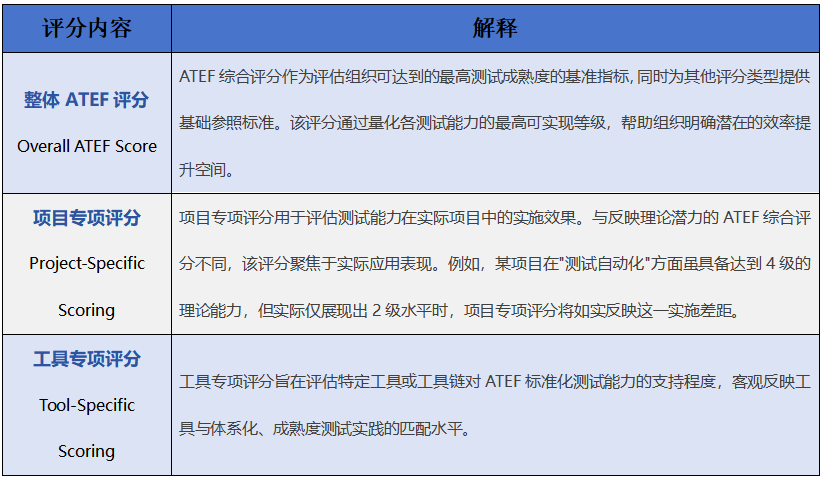

ATEF共有34项评估内容,每项评估对应不同权重因子,通过汇总每项能力评分,即可得到整体ATEF分数。评分分为3种。

如下为具体解释:

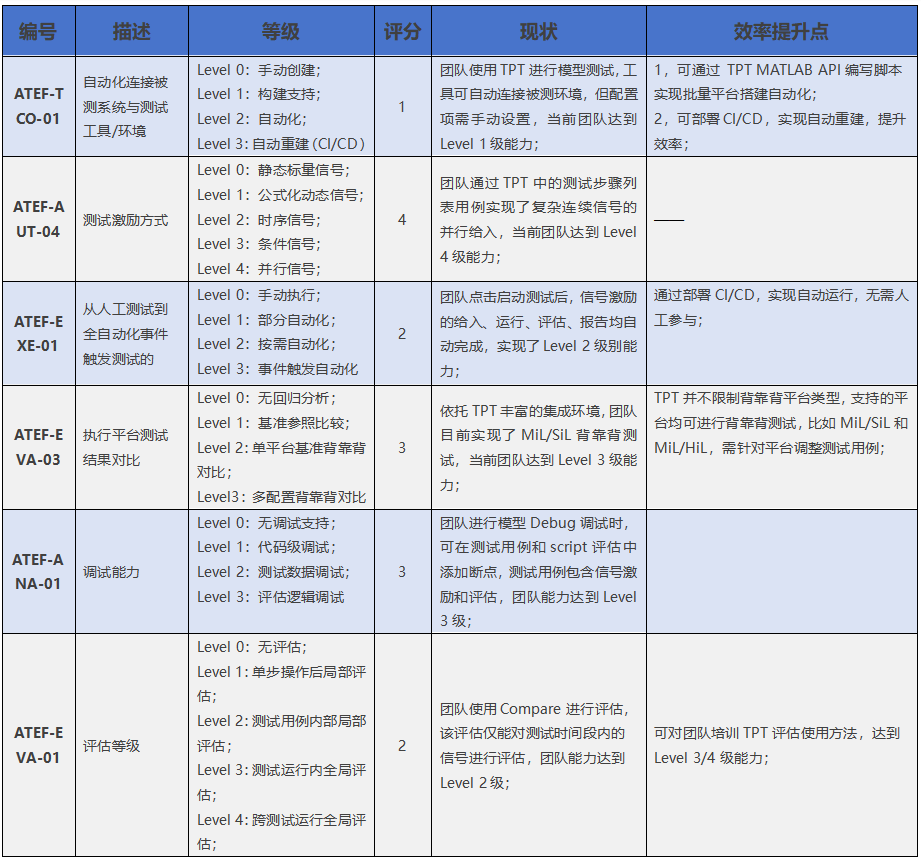

评估示例:

由于篇幅所限,当前仅列举34项能力中的6项能力进行评估,假设团队在使用TPT工具进行模型测试,如下:

除如上能力评估外,还应积极倾听团队的反馈,比如询问一线测试人员如下问题:

“当前测试方法中,哪些方面是您绝对希望保留的?”

“哪些改进能帮助您更高效或更有效地进行测试”

“您认为管理层从本次评估中最应该关注哪些重点内容”等等......

通过上述ATEF评估,不仅获得了团队清晰的能力画像,精准识别了当前测试效率的瓶颈与核心痛点,还为后续优化提供了数据驱动的改进方向。这一过程不仅实现了能力的量化呈现,更为团队持续提升测试效能奠定了科学基础。

持续改善的起点:

ATEF评估是持续优化的重要过程而非一次性任务,作为开源免费框架既支持自主评估也可寻求专业团队指导。

-

软件测试

+关注

关注

2文章

241浏览量

19437 -

汽车测试

+关注

关注

1文章

103浏览量

9517

发布评论请先 登录

解锁高品质音频体验:探索音频质量评估与测试的科学之道

如何评估协议分析仪的性能指标?

Vector推出基于芯驰E3650开发板的MICROSAR评估包

云计算开发工具包的功能

使用MPLAB Harmony v3软件框架在PIC32CM LS60 Curiosity Pro评估工具包上实现安全引导

TSP工具包软件的应用说明

最新Simplicity SDK软件开发工具包发布

基于EasyGo Vs工具包和Nl veristand软件进行的永磁同步电机实时仿真

多通道负载测试和性能评估?

FPGA仿真工具包软件EasyGo Vs Addon介绍

量化评估企业软件测试能力的评估工具包

量化评估企业软件测试能力的评估工具包

评论