Diffusion生成式动作引擎

Diffusion生成式动作引擎是一种基于扩散模型(Diffusion Models)的生成式人工智能技术,专注于生成连续、逼真的人类动作或动画序列。这类引擎在游戏开发、虚拟现实、影视动画和机器人控制等领域具有广泛应用前景。以下是其核心原理、技术实现和应用方向的详细解析:

一、核心原理

-

扩散模型基础

Diffusion模型通过逐步添加噪声破坏数据(正向过程),再学习逆向去噪过程(逆向过程),最终从随机噪声中生成目标数据。在动作生成中,数据可以是人体关节的运动轨迹(如骨骼关节点坐标、旋转角度等)。 - 动作序列建模

- 动作序列是时间连续的时空数据(多帧姿态的序列),通常用3D骨骼坐标或运动捕捉数据(MoCap)表示。

- 扩散模型被扩展为处理时间序列数据,例如通过引入时序注意力机制或循环结构(如Transformer、LSTM)。

- 条件生成

- 支持多模态输入控制(如文本、音乐、目标路径等),通过条件编码(如CLIP文本嵌入)引导动作生成的方向。

二、技术实现

- 数据准备与预处理

- 数据集:常用AMASS、Human3.6M、Mixamo等动作捕捉数据集。

- 标准化:对动作数据进行归一化,消除骨骼尺寸差异。

- 特征提取:提取关节旋转、速度、接触点等物理特征。

- 模型架构

- 主干网络:

- U-Net变体:结合时间维度卷积(1D/3D CNN)处理时序数据。

- Transformer:捕捉长距离时序依赖。

- 图卷积网络(GCN):建模人体骨骼拓扑结构。

- 扩散过程:

- 定义噪声调度(Noise Schedule),逐步破坏动作序列。

- 在逆向过程中,通过迭代预测噪声并重建动作。

- 条件控制机制

- 文本到动作:使用CLIP或BERT编码文本,通过交叉注意力注入到扩散模型。

- 音乐到舞蹈:提取音乐节拍/旋律特征,与动作节奏对齐。

- 路径规划:结合目标轨迹(如起点到终点)生成合理运动。

- 训练与推理优化

- 训练目标:最小化预测噪声与真实噪声的差异(均方误差)。

- 加速推理:采用DDIM(Denoising Diffusion Implicit Models)或Latent Diffusion减少采样步数。

三、应用场景

- 游戏与虚拟角色

- 实时生成NPC动作,提升开放世界游戏的交互真实感。

- 根据玩家输入动态生成角色动画(如战斗、对话动作)。

- 影视与动画制作

- 自动生成复杂群组动画(如人群奔跑、舞蹈)。

- 辅助关键帧补间,减少手动调整工作量。

- 机器人控制

- 生成符合物理规律的机器人运动轨迹。

- 结合强化学习优化动作策略(如行走、抓取)。

- 医疗与运动分析

- 生成康复训练动作库,个性化调整运动幅度。

- 模拟运动员动作,辅助技术优化。

四、挑战与解决方案

- 动作连贯性

- 问题:生成动作可能出现抖动或逻辑不合理。

- 方案:引入物理约束(如接触点检测、关节运动范围限制)和对抗训练(判别器网络)。

- 多模态对齐

- 问题:文本/音乐与动作的语义对齐困难。

- 方案:使用对比学习(如CLIP)增强跨模态特征匹配。

- 实时性

- 问题:扩散模型推理速度慢。

- 方案:模型蒸馏、Latent Diffusion(在低维潜在空间操作)、缓存高频动作模板。

五、开源工具与框架

- 研究项目

- MDM(Motion Diffusion Model):基于Transformer的扩散动作生成模型。

- MotionDiffuse:支持多条件控制的动作生成框架。

- Stable Diffusion扩展:适配动作生成任务的变体(如调整U-Net输入维度)。

- 开发工具

- PyTorch/TensorFlow:深度学习框架。

- Blender/Unity:动画制作与引擎集成。

- DeepMoCap:动作数据处理工具包。

六、未来方向

- 物理增强生成:结合刚体动力学模拟(如PyBullet)生成物理合理动作。

- 交互式编辑:允许用户实时调整生成动作的风格、速度、幅度。

- 跨域适应:从虚拟动作迁移到真实机器人控制(Sim2Real)。

通过扩散模型构建生成式动作引擎,能够突破传统动画制作中关键帧绑定的限制,为动态、多样化的动作生成提供强大支持。随着模型效率的提升和多模态融合技术的进步,这一领域有望成为下一代人机交互的核心技术之一。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

发布评论请先 登录

相关推荐

热点推荐

鲁班,视觉生成引擎的应用

is to create.”。三、使用场景视觉生成引擎的使用场景大致可抽象成下图。以显式输入而言,用户可以输入标签需要的风格、色彩、构图等,或者输入一个例子,或者进行一些交互的输入。除显式

发表于 04-28 15:36

Stability AI开源图像生成模型Stable Diffusion

Stable Diffusion 的很多用户已经公开发布了生成图像的样例,Stability AI 的首席开发者 Katherine Crowson 在推特上分享了许多图像。基于 AI 的图像合成可能会对艺术家和艺术领域带来一定的影响

关于生成式AI的关键技术

生成式AI的关键技术是生成式对抗网络(GANs, Generative Adversarial Networks ),其本质是一种深度学习模

SOTA生成式模型:9大类别21个模型合集

过去的两年时间里,AI界的大型生成模型发布呈井喷之势,尤其是Stable Diffusion开源和ChatGPT开放接口后,更加激发了业界对生成式模型的热情。

一文读懂Stable Diffusion教程,搭载高性能PC集群,实现生成式AI应用

PC Farm、生成式AI和Stable Diffusion模型都是非常有用的工具和技术,可以帮助用户快速构建和管理计算机集群,生成高质量的

使用OpenVINO?在算力魔方上加速stable diffusion模型

Stable Diffusion 是 stability.ai 开源的 AI 图像生成模型,实现输入文字,生成图像的功能。Stable Diffusion 将 AI 图像

优化 Stable Diffusion 在 GKE 上的启动体验

Diffusion 等应运而生。Stable Diffusion 是一个文字生成图像的 Diffusion 模型,它能够根据给定任何文本输入生成

虹软图像深度恢复技术与生成式AI的创新 生成式AI助力

当前,生成式人工智能(AI)技术的快速发展令人瞩目。它能够理解人类的描述,并在短时间内生成逼真的图像和视频。在生成

发表于 06-21 09:06

?681次阅读

高通WAIC展示两大终端侧生成式AI技术 AI引擎获奖

赋能等多个角度,描绘了混合AI赋能的智能未来。同期,第二代骁龙8的高通AI引擎获得大会最高奖项——SAIL奖(卓越人工智能引领者奖);高通还在现场带来了其强大终端侧AI赋能的生成式AI用例技术

树莓派能跑Stable Diffusion了?

Stable Diffusion是一种文本到图像生成的大型深度学习模型,它可以根据文本的描述生成详细的图像,也可以用于其他任务,如图像修复、图像扩展、图像翻译等。

投票选出你喜欢的生成式 AI 贺卡!

NVIDIA NGC Stable Diffusion XL ?是一款根据用户提供的文本内容巧妙生成相应图像作品的模型。在刚刚过去的假期,我们开展了中秋贺卡生成活动 , 聚焦于生成

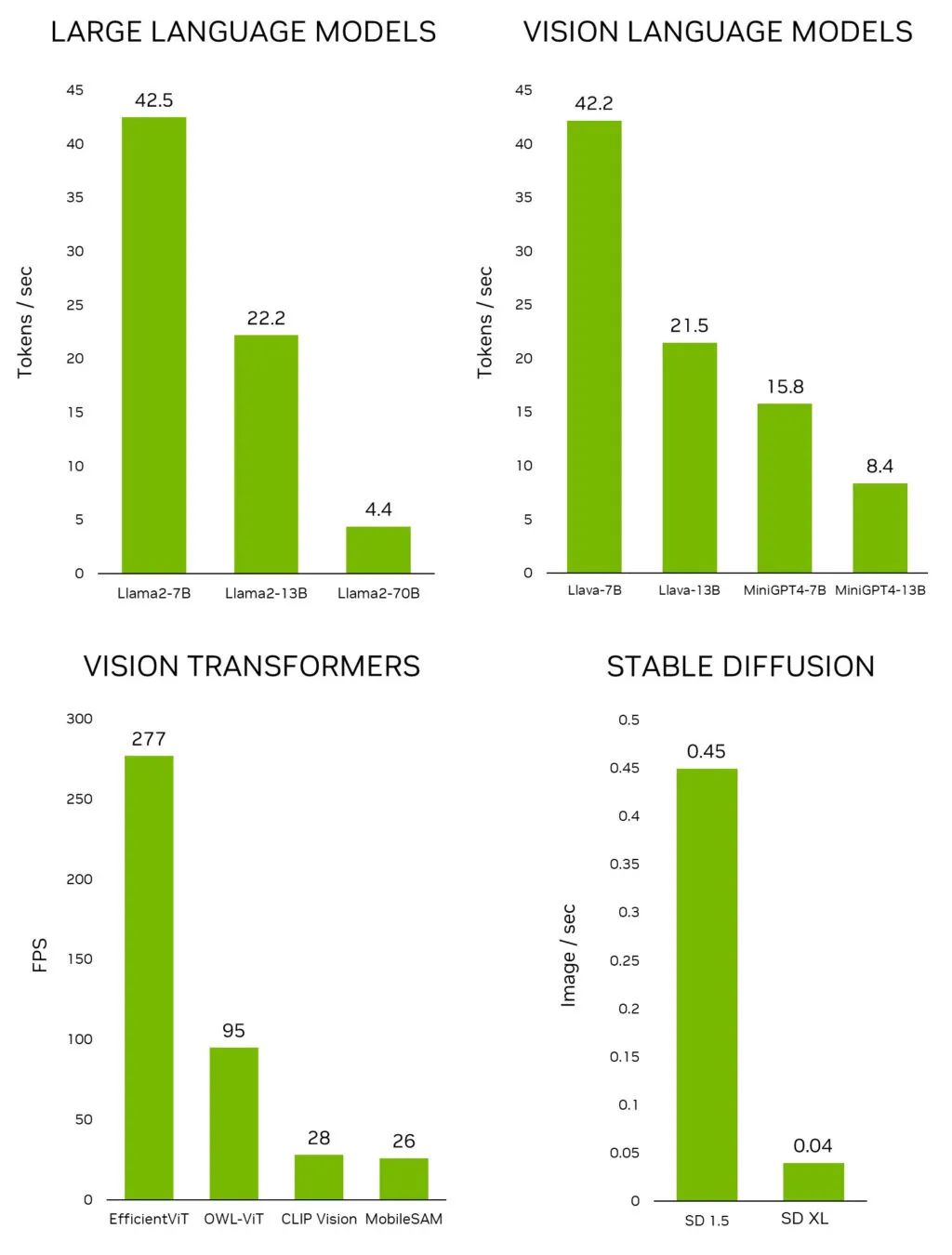

利用 NVIDIA Jetson 实现生成式 AI

近日,NVIDIA 发布了 Jetson 生成式 AI 实验室(Jetson Generative AI Lab),使开发者能够通过 NVIDIA Jetson 边缘设备在现实世界中探索生成式

火山引擎推出豆包·视频生成模型

在近期举办的2024火山引擎AI创新巡展上,火山引擎总裁谭待隆重推出了豆包·视频生成模型,这一举措标志着火山引擎在视频内容生成领域迈出了重要

IDC生成式AI白皮书亮点速递

在数字化浪潮中,生成式 AI 正成为推动创新和变革的关键力量。本文将分享由 IDC 发布的《技术革新引领未来——生成式 AI 塑造核心发展

使用OpenVINO GenAI和LoRA适配器进行图像生成

借助生成式 AI 模型(如 Stable Diffusion 和 FLUX.1),用户可以将平平无奇的文本提示词转换为令人惊艳的视觉效果。

?Diffusion生成式动作引擎技术解析

?Diffusion生成式动作引擎技术解析

评论